Jeszcze niedawno w branży technologicznej zaczynało dominować przekonanie, że nad firmą Open AI gromadzą się czarne chmury. Podczas gdy Google z sukcesem rozwijało serię Gemini, mając za sobą zaplecze całego ekosystemu Google, a Anthropic modelem Claude Opus wyznaczało nowe standardy użyteczności AI, Open AI wydawało się osiadać na laurach, publikując jedynie mniejsze aktualizacje.

Premiera GPT-5.4 przerywa tę passę, wprowadzając model zaprojektowany od podstaw do zaawansowanych zadań profesjonalnych. To przejście od prostego czatu do autonomicznego asystenta, który potrafi realizować złożone procesy inżynieryjne i analityczne przy minimalnym nadzorze człowieka.

Sercem zmian jest tryb „Thinking” oraz okno kontekstowe o rozmiarze 1 miliona tokenów (w wersji Codex). Pozwala to na analizę całych archiwów dokumentacji naraz i jawne planowanie działań przed ich wykonaniem, co drastycznie ogranicza ryzyko pomyłek (okno tej wielkości miało już od dawna Gemini i Claude). Chat GPT-5.4 działa jako system agentowy – potrafi samodzielnie zarządzać wieloetapowymi zadaniami i operować bezpośrednio w systemie operacyjnym, dobierając odpowiednie narzędzia w czasie rzeczywistym.

Postęp potwierdzają konkretne dane: 83% skuteczności w zadaniach zawodowych (benchmark GDPval) oraz spadek halucynacji faktograficznych o 33% względem wersji 5.2. Dzięki lepszemu rozumowaniu i „nauce pokory”, model rzadziej zmyśla odpowiedzi, stając się wiarygodnym narzędziem w sektorach wymagających najwyższej precyzji, takich jak finanse czy inżynieria oprogramowania.

Table of Contents

Chat GPT 5.4. w skrócie

Nie chodzi o same benchmarki, ponieważ przyzwyczailiśmy się że dla największych modeli znalezienie się na szczycie nie jest niczym przełomowym, i często po publikacji jednego modelu, inna firma wrzucała najnowszą wersje własnego modelu, która znowu znajdywała się na szczycie. Problemem jest też sama istota benchmarków: jeśli dany test jest znany, to twórcy modelu mogą optymalizować swoje rozwiązanie pod dane benchmarki.

GPT-5.4 to przełomowy model zorientowany na pracę profesjonalną, który integruje topowe zdolności kodowania (z linii Codex) z zaawansowanym rozumowaniem i natywną obsługą komputera, pozwalającą agentom na autonomiczną pracę w systemach i aplikacjach. Kluczową nowością w ChatGPT jest tryb „Thinking”, który prezentuje plan działania przed pełną odpowiedzią i umożliwia korygowanie modelu w czasie rzeczywistym, co w połączeniu z oknem kontekstowym do 1 miliona tokenów i funkcją inteligentnego wyszukiwania narzędzi drastycznie zwiększa wydajność przy mniejszym zużyciu zasobów niż w wersji 5.2. Model ustanawia nowe rekordy w testach rzeczywistych zadań (osiągając w teście GDPval wynik 83% skuteczności względem ludzkich ekspertów), oferując jednocześnie o 33% rzadsze halucynacje, znacznie lepszą estetykę prezentacji oraz potężny skok jakości w modelowaniu arkuszy kalkulacyjnych.

Według oficjalnych danych, prawdopodobieństwo wystąpienia błędów w pojedynczych faktach (halucynacji) spadło o 33% w porównaniu do wersji 5.2, a ogólna liczba błędnych odpowiedzi zmniejszyła się o 18%.

Warto przypomnieć, że premiera „podstawowej” wersji GPT 5 była dla wielu momentem specyficznego rozczarowania. Choć GPT-5 był obiektywnie solidnym i wydajnym narzędziem, nie zdołał udźwignąć gigantycznego ciężaru oczekiwań, jakie narosły wokół OpenAI po sukcesach wersji 3.5, 4o, i modeli specjalistyczny z serii „o” Branża, karmiona wizjami bliskiego AGI, liczyła na rewolucję, a otrzymała jedynie ewolucyjne szlify, które w starciu z rozpędzonym Claude’em czy Gemini wydawały się zachowawcze. Open AI wyciągnęło z poprzedniej premiery wnioski, nowy model wypuszczany jest niemalże z zaskoczenia.

Chat GPT musi być potężny, musi mieć unikalne funkcje i przewagi, żeby przetrwać konkurencje z Google, Claude i Grokiem i Llama.

Przez długi czas ChatGPT praktycznie nie miał konkurencji, która by mu zagrażała. Wspomniane wcześniej Gemini, Grok czy Claude już od dłuższego czasu tworzą produkty dorównujące Chatowi GPT, ale firma OpenAI miała oczywiste przewagi wynikające z faktu, że była pierwsza na rynku. ChatGPT stał się synonimem modelu językowego; program ten oferował też najwięcej funkcji (jak np. projekty).

Google długo nie było w stanie dogonić konkurencji, co dla wielu było zaskoczeniem – w końcu od dwóch dekad firma ta uchodziła za lidera w dziedzinie algorytmów i AI. To przecież Tłumacz Google (debiutujący w 2006 roku) był przełomowym narzędziem, a publikacja naukowa „Attention Is All You Need” z czerwca 2017 roku, opracowana przez badaczy z Google Research i Google Brain, dała podstawę współczesnym modelom językowym opartym na transformerach.

Od około roku Google wróciło do czołówki, a od paru miesięcy w wielu aspektach przegania ChatGPT. Google ma kilka kluczowych przewag:

- Dostęp do istniejących algorytmów i ogromnej bazy danych (YouTube, Mapy, Firmy, wyszukiwarka).

- Ekosystem – Dysk Google, dokumenty Google, Gmail, system operacyjny.

Punkt pierwszy dawał wizję tego, że AI od Google w przyszłości zostawi konkurencję w tyle, więc warto te systemy wdrożyć i w nie inwestować. Punkt drugi oznacza, że wiele osób i firm ma dostęp do płatnego AI „przy okazji”, np. korzystając z chmury Google.

Jeśli więc można wydać 20 dolarów miesięcznie i dzięki temu mieć dostęp do Dysku Google, przestrzeni Workspace itp., to brakuje powodów, aby dodatkowo wydawać 20 dolarów na nieco lepszego Chata GPT.

Reszta konkurencji, Claude, Grok, Llama

Dla osób którym zależy na bardziej etycznym i kreatywnym AI, domyślnym wyborem jest Claude. Anthropic to firma założona przez byłych pracowników Open AI, w którą mocno zainwestowało Google. Mniejszej firmie łatwiej jest zachować autentyczność. Open AI nie jest już postrzegana jako „fajny startup który zrobił coś przełomowego. Wyolbrzymione obietnice możliwości nowych modeli, dziwne operacje finansowe z Oracle I Nvidią sprawiły że firma ta jest postrzegana jako kolejne wielkie bezduszne korpo.

Dalej mamy Groka, którego przewagą jest „Twixer” (dawniej Twitter, obecnie X), oraz Tesle i roboty (Tesla Optimus). Ostatnim elementem układanki są produkty od Mety, czyli bardziej otwarte modele z serii Llama, oraz inne otwarto źródłowe modele tworzone przez szereg mniejszych instytucji.

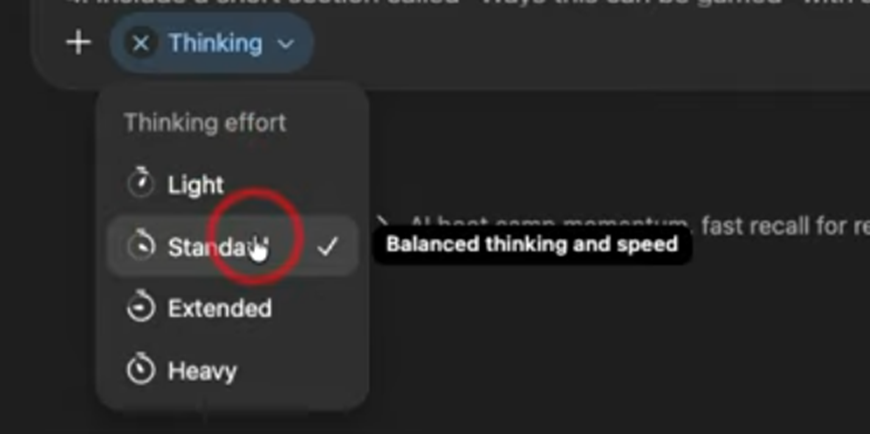

Wybór trybu myślenia i dodawanie nowych komend podczas gdy Chat GPT pracuje, bez konieczności przerwania sesji.

Warto również wspomnieć o najnowszych zmianach w samym interfejsie i logice działania GPT-5.4, gdzie wprowadzono cztery odrębne tryby „myślące”. W tym ustawieniu model nie generuje odpowiedzi natychmiastowo; zamiast tego samodzielnie inicjuje serię komend, porównuje uzyskane wyniki i dopiero na podstawie tak przeprowadzonego „mini-badania” konstruuje finalną treść.

Kluczowa innowacja dotyczy jednak samej warstwy UX (User Experience). OpenAI wprowadziło funkcję, która pozwala na bieżąco korygować proces myślowy maszyny. Jeśli w trakcie pracy modelu uznamy, że warto coś dodać lub zauważymy, że analiza zmierza w złym kierunku, możemy wysłać nową instrukcję bez konieczności przerywania sesji czy restartowania generowania. To dynamiczne doprecyzowanie sprawia, że interakcja staje się bardziej płynna, choć – jak pokazują rankingi – nawet takie udogodnienia nie wystarczają, by uciszyć głosy krytyki dotyczące etyki i ogólnej wydajności systemu.

Chat GPT 5.4. to potężne narzędzie do programowania (vibecodowania)

Produkty od OpenAI bardzo dobrze radziły sobie w programowaniu, a skok jakości kodowania był główną zaletą GPT-5 (w innych aspektach progres nie był aż tak duży). Ostatnio jednak Google zaczęło podkopywać pozycję OpenAI, głównie za sprawą aplikacji Antigravity – edytora kodu źródłowego zintegrowanego z Gemini oraz Claude. Gemini 3 (wraz z nowszymi wersjami) szczególnie dobrze radzi sobie z frontendem i wizualnymi aspektami programów. Wspomniany Claude ma z kolei opinię modelu LLM, który świetnie radzi sobie ze złożonymi problemami logicznymi w kodzie. Zarówno Gemini, jak i Claude oferują przy tym znacznie większe okno kontekstowe niż starsze modele od OpenAI.

W przypadku wersji 5.4 widzimy jednak kolejny duży skok w możliwościach programistycznych. Kiedy połączymy ten model z narzędziem Codex (agentem programistycznym od OpenAI), potrafi on pracować nad całymi projektami, tworząc i modyfikując wiele plików naraz. Warto wspomnieć, że obecnie istnieje możliwość pobrania dedykowanej aplikacji Codex – przez długi czas GPT wymagał bezpośredniego połączenia z repozytorium na GitHubie, a dla wielu osób pobranie osobnej aplikacji może być prostsze niż konfiguracja GitHuba. Codex możemy również połączyć z zaawansowanymi środowiskami programistycznymi, takimi jak Visual Studio.

Dobrym mini-benchmarkiem zdolności kodowania jest tworzenie prostych, estetycznych programów, zwłaszcza tych operujących na obiektach trójwymiarowych. Takie testy są łatwo zrozumiałe dla każdego, nawet bez doświadczenia w programowaniu. Realne możliwości modelu dobrze obrazuje poniższy film:

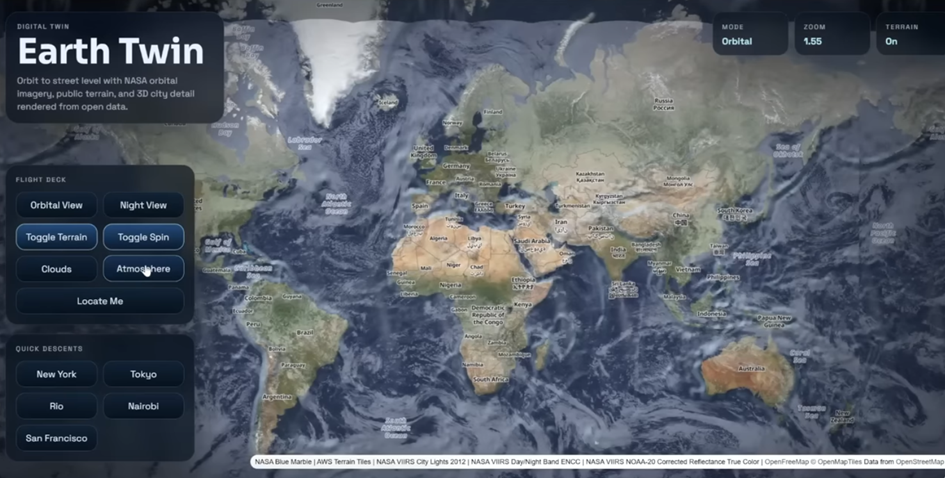

Za pomocą zaledwie kilku promptów GPT-5.4 jest w stanie stworzyć dopracowany wizualnie program, który wyświetla dane meteorologiczne z całego świata na interaktywnym modelu 3D.

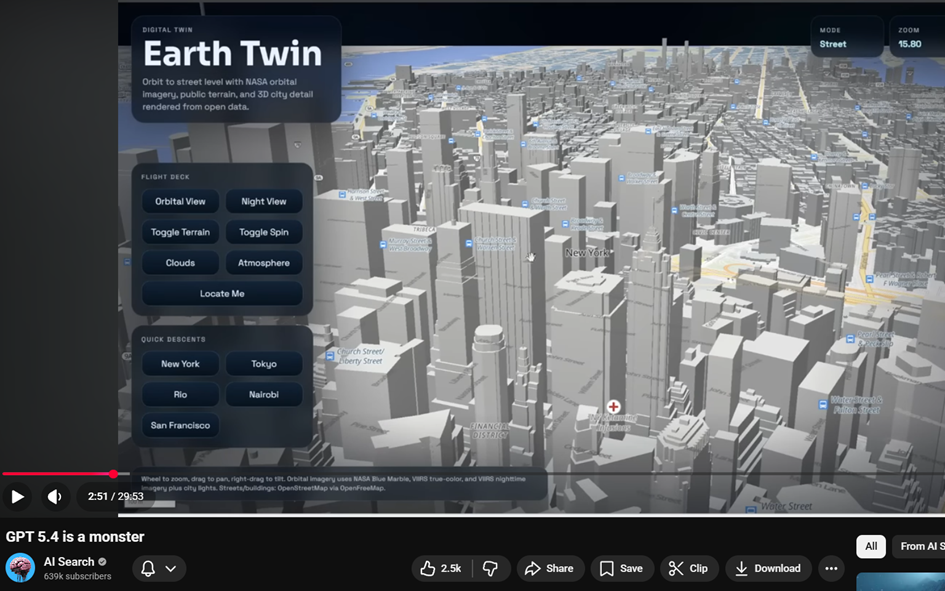

Dodanie podglądu 3d różnych miast również nie jest problemem:

Oczywiście GPT nie budował silnika 3D i obiektów 3D od zera, tylko po prostu korzystał z gotowych bibliotek i rozwiązań, ale nadal jest to imponujące osiągnięcie.

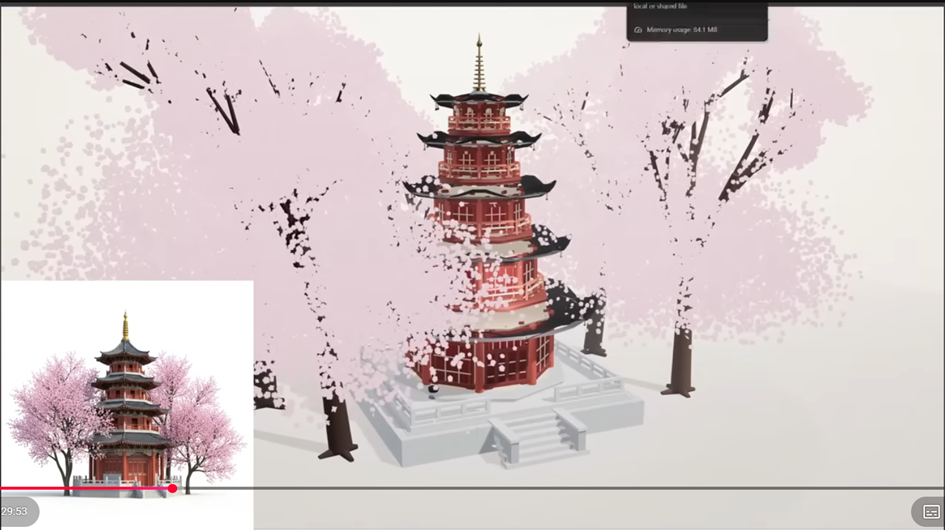

Przy czym GPT 5.4. potrafi samodzielnie operować na obiektach 3D. Tu np. stworzył złożony obiekt na podstawie zdjęcia:

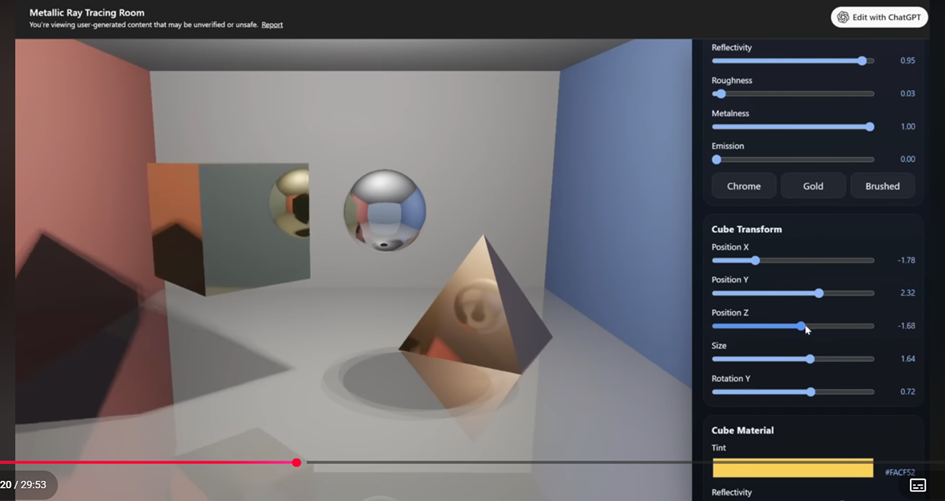

A tutaj stworzył mini-symulator, w którym można przesuwać obiekty i który poprawnie operuje światłem oraz odbiciami. Symulowanie lustra w przestrzeni 3D jest dość trudnym wyzwaniem programistycznym, dlatego w wielu grach rezygnuje się z luster i realistycznych odbić.

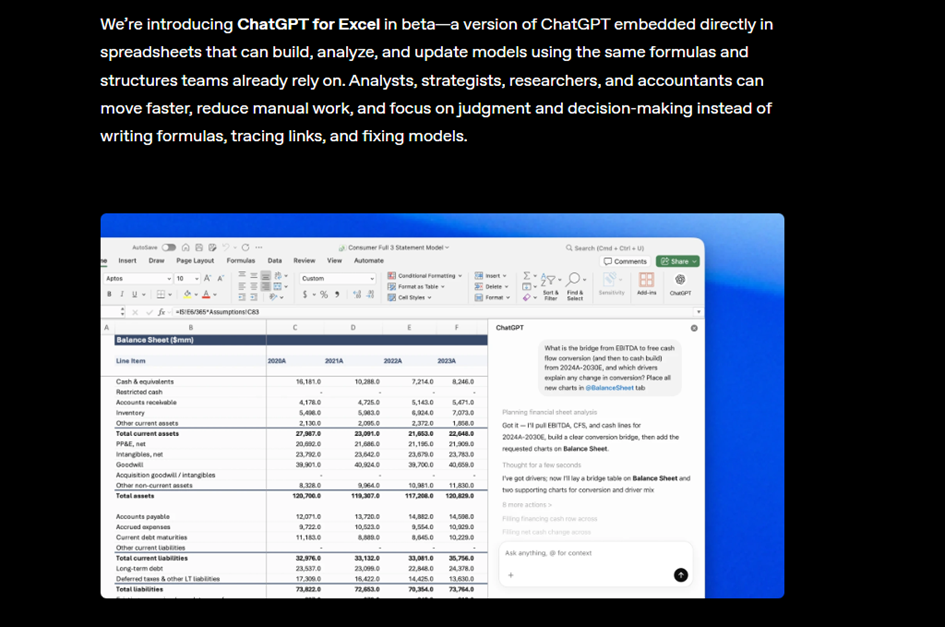

Chat GPT 5.4. jest dostosowany do pracy z Excelem, w najbliższym czasie ukaże się specjalna wtyczka.

Chat GPT-5.4 jest dostosowany do pracy z tabelami. Wraz z najnowszą premierą wypuszczono wtyczkę do Excela, choć na razie jest ona dostępna tylko w fazie beta. Można się w tym pogubić, ponieważ już od paru lat istnieje wiele wtyczek typu „GPT for Excel”, tworzonych przez firmy trzecie. Część z nich jest porządna, część nie działa, a niektóre mogą być wręcz niebezpieczne.

Tym samym OpenAI idzie w ślady Anthropic, którego model Claude już od jakiegoś czasu posiada integrację z Excelem. Integracja Gemini z Arkuszami Google jest dość ograniczona; w arkuszach możemy rozmawiać z AI o naszych danych, uzyskać porady dotyczące formuł, a w najlepszym wypadku – gdy mamy ustawiony język angielski – wygenerować prostą tabelę do wstawienia do arkusza. Podobnie jest w przypadku Copilota od Microsoftu (Windows), choć tutaj sytuacja wygląda jeszcze gorzej, gdyż nie da się wstawić nawet prostych tabel.

Optymalizacja pod konkretne zadania, np. związane z finansami.

GPT-5.4 reprezentuje fundamentalną zmianę w strategii rozwoju OpenAI, przesuwając ciężar z ogólnej wszechstronności w stronę wąskiej, profesjonalnej specjalizacji. Najlepszym dowodem na tę ewolucję są wyniki w benchmarku GDPval, który testuje zdolność sztucznej inteligencji do wykonywania realnych zadań w ramach kilkudziesięciu różnych zawodów. Model ten nie tylko dorównuje ludzkim ekspertom, ale wręcz ich wyprzedza, osiągając lepsze lub równe wyniki w oszałamiających 83% przypadków. W świecie finansów oznacza to przejście od generowania prostych definicji do tworzenia zaawansowanych struktur analitycznych, które do tej pory wymagały wielogodzinnego zaangażowania wykwalifikowanych pracowników.

Duża pomoc w analizie inwestycyjnej

Jednym z najbardziej imponujących osiągnięć nowej architektury jest jej wydajność w zadaniach typowych dla młodszych analityków bankowości inwestycyjnej. W testach symulujących złożone modelowanie w arkuszach kalkulacyjnych GPT-5.4 osiągnął poziom poprawności wynoszący 87,5%, co stanowi ogromny skok jakościowy względem poprzednich wersji. Dzięki natywnym wtyczkom do programów Excel i Arkusze Google model potrafi teraz samodzielnie nawigować po komórkach, rozumieć skomplikowane zależności między formułami i budować prognozy wzrostu bezpośrednio w środowisku pracy profesjonalisty. To rozwiązanie eliminuje błędy kopiowania danych i pozwala na automatyczną weryfikację spójności modeli finansowych przy minimalnym nadzorze ze strony użytkownika.

Przetwarzanie gigantycznych zbiorów danych

Prawdziwa potęga GPT-5.4 w kontekście biznesowym objawia się podczas pracy z dokumentacją o długim horyzoncie czasowym. Dzięki oknie kontekstowemu sięgającemu miliona tokenów model jest w stanie „przeczytać” i zestawić ze sobą wieloletnie archiwa raportów finansowych czy tysiące faktur bez ryzyka utraty wątku. Działa on jak autonomiczny agent, który potrafi wyłuskać kluczowe wskaźniki efektywności z setek stron dokumentacji i zsyntetyzować je w formie profesjonalnego raportu PDF. Co niezwykle istotne, model wykonuje te operacje przy znacznie mniejszym zużyciu tokenów niż starsze wersje, co sprawia, że najbardziej złożone audyty finansowe stają się nie tylko dokładniejsze, ale również tańsze i szybsze w realizacji.

Mniejsza ilość halucynacji

W nowym modelu GPT-5.4 OpenAI postawiło na głębokie zmiany w architekturze, które realnie uderzają w największą bolączkę AI – halucynacje. Dzięki nowym technologiom prawdopodobieństwo wystąpienia błędów w pojedynczych faktach spadło aż o 33% względem wersji 5.2, a ogólna liczba mylnych odpowiedzi zmniejszyła się o 18%.

Sukces ten opiera się na kilku kluczowych filarach:

- Tryb „Thinking” i jawny plan rozumowania: To najważniejsza zmiana procesowa. GPT-5.4 nie wyrzuca z siebie tekstu natychmiast; zamiast tego najpierw konstruuje wewnętrzny, widoczny dla użytkownika plan. Model „zastanawia się” nad strukturą odpowiedzi, co pozwala mu wyłapać błędy logiczne jeszcze przed ich sformułowaniem. Co więcej, jako użytkownik możesz interweniować w trakcie tego procesu, korygując kierunek myślenia maszyny u samego źródła.

- Agentowe przeszukiwanie sieci: System Deep Web Research przestał być prostą wyszukiwarką linków. Teraz działa jak autonomiczny agent, który weryfikuje informacje w wielu źródłach jednocześnie. Dzięki temu model znacznie lepiej radzi sobie z wyłapywaniem szczegółów ukrytych głęboko w tekstach źródłowych, co wcześniej często prowadziło do „zmyślania” brakujących faktów.

- Duże okno kontekstowe: Zwiększenie pamięci do 1 miliona tokenów w wersjach Codex i Pro radykalnie poprawiło spójność faktograficzną. Halucynacje często wynikały z „zapominania” przez AI danych podanych na początku długiej sesji; przy tak ogromnym oknie model ma stały dostęp do całości materiału, więc nie musi zgadywać kontekstu.

- Kalibracja pewności i „nauka pokory”: Dzięki udoskonalonemu treningowi (RLHF), GPT-5.4 potrafi lepiej ocenić stopień własnej wiedzy. Został zaprogramowany tak, by częściej przyznawać się do niewiedzy, zamiast generować jedynie prawdopodobne brzmiące kłamstwa. W sytuacjach ekstremalnie trudnych model może też uruchomić tryb Extreme Reasoning, poświęcając więcej mocy obliczeniowej na weryfikację skomplikowanych zagadnień naukowych.

Co ciekawe, ta większa merytoryczność pozwoliła jednocześnie na redukcję zbędnych odmów. Poprzednie modele, bojąc się popełnienia błędu, często asekuracyjnie odmawiały odpowiedzi. GPT-5.4, dzięki lepszemu zrozumieniu własnych ograniczeń i danych, potrafi bezpieczniej nawigować po faktach, rzadziej zasłaniając się generycznymi zastrzeżeniami.

Wygląda na to, że OpenAI w końcu uczy swoje dziecko, że „nie wiem” to czasem najlepsza odpowiedź – paradoksalnie czyniąc je przez to znacznie mądrzejszym.

Co z GPT 5.3.

Wielu użytkowników może się zastanawiać, co stało się z wersją 5.3, która przemknęła przez rynek bez tak wielkiego echa jak najnowsza odsłona. W rzeczywistości GPT-5.3 było klasycznym prostym uptadem skupionym niemal w całości na optymalizacji wydajności i redukcji opóźnień. Podczas gdy wersja 5.2 wyznaczyła fundamenty, a 5.4 przyniosła potężne zdolności rozumowania, 5.3 pełniło rolę silnika, który miał sprawić, by interakcja z AI była niemal natychmiastowa. To właśnie wtedy OpenAI wprowadziło tryb „/fast”, który pozwolił programistom i analitykom na błyskawiczne iterowanie kodu bez czekania na długie procesy „myślenia” modelu.

Dlatego właśnie model GPT 5.4. jest porównywany do GPT 5.2.

Aktualne kłopoty chata GPT i Open AI

W świecie technologii zawrzało po doniesieniach o kontrowersyjnych decyzjach OpenAI, które rzucają cień na etyczny fundament tej firmy. Coraz więcej użytkowników decyduje się na porzucenie Chata GPT, a powód jest niezwykle poważny: wybór między bezpieczeństwem ludzkości a kontraktami zbrojeniowymi. Podczas gdy konkurencyjne Anthropic odmówiło współpracy z Pentagonem przy budowie „botów-zabójców” i narzędzi do masowej inwigilacji – trafiając za to na rządową czarną listę – OpenAI bez wahania zajęło ich miejsce, nawiązując bliską relację z sektorem militarnym.

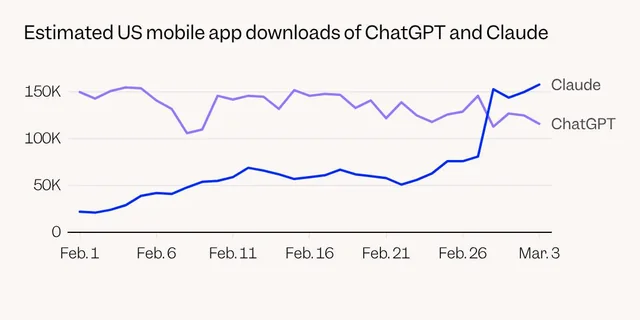

Skala buntu przeciwko OpenAI przybiera na sile pod szyldem ruchu #QuitGPT, który zebrał już niemal 2,5 miliona deklaracji rezygnacji z subskrypcji. Użytkownicy, rozczarowani postawą giganta, masowo migrują do Claude’a. Aplikacja Anthropic nie schodzi z pierwszego miejsca w App Store, stając się nowym domem dla tych, którzy cenią etykę i bezpieczeństwo danych wyżej niż agresywną ekspansję rynkową.

Dla wielu osób odejście od Chata GPT to nie tylko manifest polityczny, ale też wyzwanie logistyczne. Kluczowe staje się zabezpieczenie dotychczasowej pracy i przeniesienie wypracowanych schematów na nowe platformy. Coraz większą popularność zyskują poradniki dotyczące „przyszłościowej” architektury pamięci AI, które pozwalają uniezależnić się od jednego dostawcy i bezpiecznie zarządzać swoimi danymi, bez względu na to, czy ostatecznie wybierzemy Claude’a, czy inne rozwiązanie dbające o standardy etyczne.

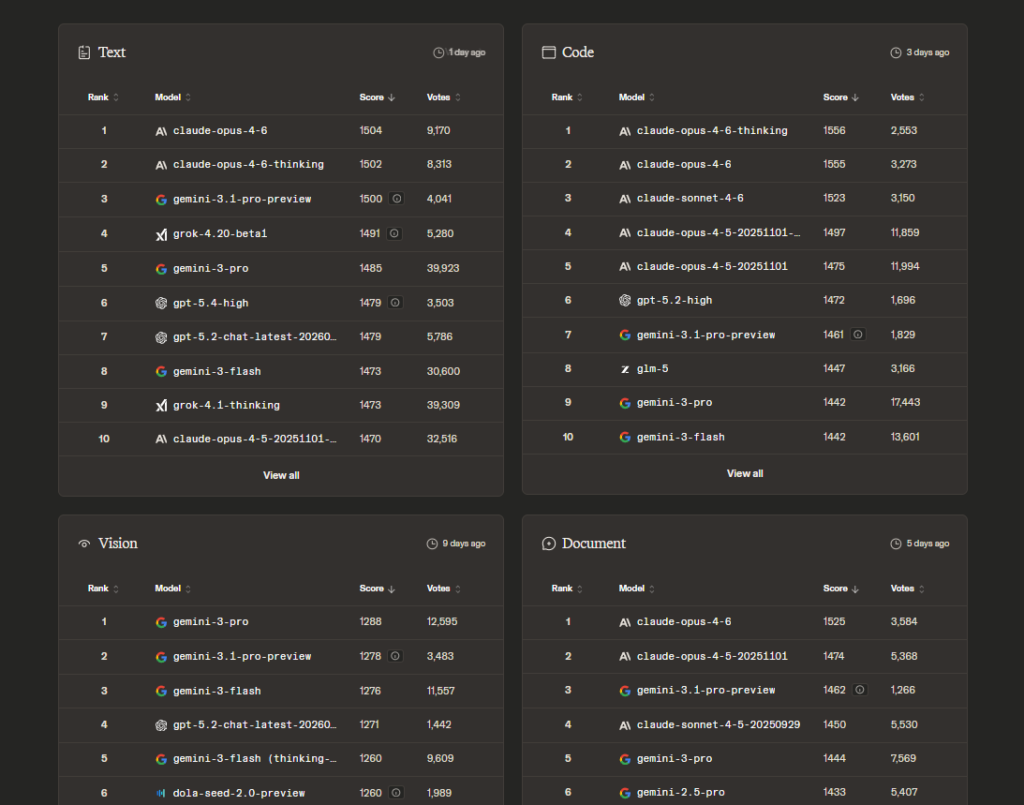

Spadek formy: GPT traci dystans w rankingach

Problemy wizerunkowe OpenAI idą w parze z wyraźnym zadyszką technologiczną, co potwierdzają najnowsze zestawienia LMM Arena. Jakościowo modele GPT przestały dominować, oddając pole konkurencji w niemal każdej kluczowej kategorii. W rankingu ogólnym tekstowym (Text) flagowe modele OpenAI, takie jak gpt-5.4-high, zajmują dopiero odległe pozycje, dając się wyprzedzić nie tylko rodzinie Claude, ale i modelom Gemini.

Sytuacja wygląda jeszcze gorzej w specjalistycznych zastosowaniach:

- Kodowanie (Code): Podium zostało całkowicie zdominowane przez modele Anthropic (Claude Opus i Sonnet), podczas gdy najwyżej notowany model GPT znajduje się dopiero na 6. miejscu.

- Analiza dokumentów (Document): Tutaj również prym wiedzie Claude Opus 4-6, a OpenAI wypada poza pierwszą piątkę, przegrywając z rozwiązaniami od Google.

- Zadania wizualne (Vision): W tej kategorii dominacja Gemini jest bezdyskusyjna – modele Google zajmują całe podium, spychając GPT na 4. pozycję.

Oczywiście należy pamiętać, że do wyników LMM Arena trzeba podchodzić z pewnym dystansem. Rankingi oparte na crowdsourcingu i subiektywnych odczuciach użytkowników mogą być podatne na chwilowe trendy lub specyficzne sposoby konstruowania promptów. Niemniej jednak, gdy tak ogromna próba głosujących konsekwentnie wskazuje na wyższość Claude i Gemini, staje się to jasnym sygnałem rynkowym: OpenAI straciło pozycję niekwestionowanego lidera jakości, a „król AI” jest obecnie w defensywie.

Podsumowane

Premiera GPT-5.4 to moment, w którym OpenAI definitywnie kończy okres defensywy i przechodzi do zdecydowanej kontrofensywy. Po czasie, gdy konkurencyjne ekosystemy od Google czy precyzja Claude’a od Anthropic zaczęły realnie podgryzać pozycję lidera, gigant z San Francisco zaprezentował model, który przestaje być jedynie „inteligentnym rozmówcą”, a staje się autonomicznym partnerem zawodowym. Skupienie się na pracy profesjonalnej, integracja z narzędziami takimi jak Codex oraz natywna obsługa komputera sprawiają, że GPT-5.4 wyznacza nową granicę użyteczności sztucznej inteligencji. To już nie tylko wyścig na benchmarki, ale realna bitwa o to, kto dostarczy narzędzie zdolne do samodzielnego wykonywania złożonych, wieloetapowych zadań przy minimalnym nadzorze człowieka.

Największym przełomem, jaki przynosi nowa aktualizacja, jest drastyczna poprawa merytoryczności. Redukcja halucynacji o 33% oraz wprowadzenie trybu „Thinking” z jawnym planem rozumowania zmieniają dynamikę pracy z modelem. Możliwość korygowania działań AI w czasie rzeczywistym, bez przerywania jej pracy, to rewolucja w zakresie doświadczenia użytkownika (UX), która eliminuje frustrację związaną z błędnym interpretowaniem poleceń. W połączeniu z ogromnym oknem kontekstowym sięgającym miliona tokenów oraz potężnymi zdolnościami w obszarze programowania i modelowania finansowego, GPT-5.4 staje się systemem, któremu można powierzyć krytyczne procesy biznesowe. Wynik 83% skuteczności względem ludzkich ekspertów w zadaniach zawodowych to jasny sygnał, że AI wchodzi na poziom kompetencji dotychczas zarezerwowany dla wykwalifikowanych specjalistów.

Powrót do korzeni w nowoczesnym wydaniu

Dla wielu użytkowników, którzy – podobnie jak ja – zaczęli zerkać w stronę Gemini ze względu na jego szybkość i integrację z ekosystemem Google, GPT-5.4 jest potężnym argumentem za powrotem do OpenAI. Choć przewaga Google w dostępie do danych i narzędzi biurowych jest niezaprzeczalna, to unikalne funkcje wersji 5.4, takie jak zaawansowane kodowane, natywne wtyczki do Excela czy agentowe przeszukiwanie sieci, oferują głębię analityczną, której konkurencji wciąż brakuje. Wygląda na to, że OpenAI wyciągnęło lekcję z zachowawczych premier z przeszłości. Nowy model nie próbuje nas już tylko czarować płynną mową, ale uczy się pokory i precyzji, stając się narzędziem skrojonym pod konkretne, trudne wyzwania współczesnego rynku pracy. OpenAI nie tylko wyszło z dołka – ono właśnie wytyczyło nowy kierunek rozwoju dla całej branży.