Okno kontekstowe w AI to jedno z tych pojęć, które co chwilę przewijają się w rozmowach o sztucznej inteligencji, a jednocześnie rzadko kiedy są dobrze wyjaśnione. Użytkownik widzi po prostu czat lub pole tekstowe; wpisuje pytanie, dostaje odpowiedź. Gdzieś w tle model musi jednak zdecydować, ile z tej rozmowy jest w stanie naraz „mieć w głowie”. Właśnie to określa okno kontekstowe.

Najprościej mówiąc, okno kontekstowe to maksymalna ilość tekstu, jaką model językowy może wziąć pod uwagę w jednym wywołaniu. To nie jest pamięć trwała ani historia całej współpracy z użytkownikiem, ale coś bliższego pamięci krótkotrwałej. Model widzi pewien fragment konwersacji, dokumentu czy zadania, przelicza go, generuje odpowiedź, a reszta pozostaje poza zasięgiem.

Ten limit nie jest wyrażany w zdaniach ani znakach; technicznie liczy się tokeny. Token to kawałek tekstu: czasem jedna litera, czasem kilka liter, czasem całe słowo. W praktyce można przybliżyć, że kilka tysięcy tokenów odpowiada mniej więcej kilku stronom tekstu. W zależności od konkretnego modelu okno kontekstowe może mieć rozmiar rzędu tysięcy albo setek tysięcy tokenów.

Rozumienie tej koncepcji jest kluczowe dla każdego, kto chce sensownie używać AI albo ją integrować z własnymi systemami. Od wielkości okna, sposobu jego wykorzystania oraz od tego, jak świadomie zarządzamy kontekstem, zależy jakość odpowiedzi, stabilność działania i opłacalność całego rozwiązania.

Spis Treści

Okno kontekstowe a „pamięć” modelu

Pamięć krótkotrwała modelu

Często mówi się, że model „pamięta” rozmowę. To skrót myślowy; tak naprawdę model nie ma długotrwałej pamięci o użytkowniku czy sesji, chyba że jest to dodatkowo zaimplementowane. Za każdym razem dostaje pewien pakiet danych wejściowych, przetwarza go i zwraca wynik. Tym pakietem jest właśnie zawartość okna kontekstowego.

Jeżeli rozmowa jest krótka, cała historia może zmieścić się w oknie. Jeśli trwa długo, wcześniejsze fragmenty muszą zostać usunięte, streczone albo przeniesione do zewnętrznej pamięci. Z punktu widzenia modelu one przestają istnieć. Dlatego użytkownik czasem ma wrażenie, że system „zapomniał” coś, co powiedzieliśmy pół godziny temu; w rzeczywistości wyleciało to po prostu poza okno kontekstowe.

Kontekst instrukcji, danych i stylu

W oknie kontekstowym mieści się nie tylko sama rozmowa. Zwykle składamy je z kilku rodzajów informacji.

Najczęściej są to

• instrukcje: jak model ma się zachowywać, jakim tonem pisać, czego unikać

• dane użytkownika: pytania, teksty, dokumenty, przykłady

• dodatkowe materiały: opisy produktów, dane z bazy, fragmenty specyfikacji, wyniki wyszukiwania

• wcześniejsze odpowiedzi modelu, jeśli chcemy zachować ciągłość dialogu

To wszystko konkuruje o miejsce. Im więcej instrukcji i danych „systemowych”, tym mniej miejsca na długą historię rozmowy. Dlatego sensowne gospodarowanie miejscem w oknie kontekstowym staje się sztuką samą w sobie. Choć rozmiar okna kontekstowego w modelach językowych regularnie rośnie, to powiększanie go nie jest zbyt łatwe.

Dlaczego okno kontekstowe jest tak ważne

Jakość odpowiedzi a ilość kontekstu

Model językowy działa statystycznie. Im więcej ma informacji o sytuacji, celu, ograniczeniach i przykładach, tym łatwiej generuje trafną odpowiedź. Zbyt mało kontekstu skutkuje odpowiedziami ogólnymi, oderwanymi od realiów firmy, projektu czy konkretnej sprawy użytkownika.

Z drugiej strony zbyt dużo tekstu może model przytłoczyć; nie dlatego, że „się męczy”, lecz dlatego, że w ogromnej ilości danych trudno jest mu rozpoznać, co jest naprawdę ważne. W praktyce pojawia się efekt rozmycia: model widzi wszystko, ale nic nie traktuje jako kluczowe.

Okno kontekstowe jest więc obszarem kompromisu. Musimy zmieścić w nim wszystko, co naprawdę ma znaczenie, ale nie powinniśmy wrzucać tam bezrefleksyjnie całej historii, każdego dokumentu i każdej wiadomości.

Granica między „magią” a „dziwne zachowaniem”

Wrażenie „magii” w używaniu AI pojawia się wtedy, gdy model zdaje się nas doskonale rozumieć: pamięta wcześniejsze ustalenia, odwołuje się do wcześniejszych przykładów, spójnie kontynuuje styl. Ten efekt powstaje właśnie dzięki dobrze dobranemu kontekstowi.

Z kolei większość „dziwnych” zachowań, które widzi użytkownik, ma swoje źródło w źle użytym oknie kontekstowym. Na przykład:

• model nagle ignoruje ważną zasadę, którą ustaliliśmy dawno temu

• myli dwa podobne byty, bo oba są opisane w kontekście, ale rozdzielone w czasie

• traci wątek i odpowiada na wcześniejsze pytanie zamiast na bieżące

Zrozumienie mechaniki okna kontekstowego pozwala takie zjawiska diagnozować i ograniczać.

Techniczne podstawy okna kontekstowego

Transformery i mechanizm self attention

Nowoczesne modele językowe oparte są na architekturze transformer. Jej sercem jest mechanizm self attention, który dla każdego tokenu patrzy na wszystkie inne tokeny w sekwencji i uczy się, które z nich są dla niego istotne.

To właśnie na etapie projektowania transformera określa się maksymalną długość sekwencji. Model musi być w stanie trzymać wszystkie tokeny w pamięci podczas przetwarzania, a złożoność obliczeniowa rośnie mniej więcej z kwadratem długości sekwencji. Dwukrotne zwiększenie maksymalnego kontekstu oznacza znacznie więcej pracy dla modelu.

Z tego powodu okno kontekstowe jest parametrem twardym. Nie da się go przekroczyć wprost; jeśli dostarczymy więcej tekstu, trzeba go obciąć albo w inny sposób przygotować.

Kompromis między kosztami a możliwościami

Duże okno kontekstowe daje wygodę: można wrzucić obszerny dokument, całą transkrypcję spotkania, długą historię czatu. Jednak każdy dodatkowy token oznacza większe zużycie zasobów obliczeniowych, a więc wyższy koszt i dłuższy czas odpowiedzi.

Dlatego producenci modeli i projektanci systemów szukają złotego środka. Z jednej strony chcą zapewnić użytkownikowi możliwość pracy z dużą ilością treści, z drugiej muszą kontrolować koszty i opóźnienia. Stąd różne strategie, dzięki którym użytkownik ma wrażenie „długiej pamięci”, nawet jeśli pojedyncze wywołanie widzi tylko wycinek całości.

Typowe ograniczenia i problemy z oknem kontekstowym

Ucinanie i „zapominanie” treści

Pierwszym oczywistym ograniczeniem jest twardy limit długości. Gdy przekroczymy maksymalną liczbę tokenów, trzeba coś wyrzucić. Najprostsza strategia to obcięcie najstarszej części rozmowy. Działa to podobnie jak czat, w którym znika historia sprzed kilku dni.

Problem w tym, że to, co najstarsze, nie zawsze jest najmniej istotne. Często fundamentalne zasady, definicje pojęć czy ustalenia projektowe pojawiają się na początku współpracy i są potrzebne cały czas. Jeśli wylecą z okna, model przestanie ich pilnować i zacznie udzielać odpowiedzi, które z nimi kolidują.

Dryf kontekstu

Drugi problem to dryf kontekstu, czyli stopniowe odjeżdżanie odpowiedzi od tego, co było uzgodnione. Zaczyna się niewinnie. Model trochę inaczej interpretuje termin, lekko zmienia styl, pomija któryś z warunków. Gdy rozmowa trwa długo, te drobne odchylenia kumulują się i po godzinie mamy asystenta, który niby jest ten sam, ale zachowuje się inaczej niż na początku.

Dryf kontekstu przyspiesza, gdy okno kontekstowe jest małe, a my nie pilnujemy, jakie informacje w nim zostają. Jeśli nie przypominamy modelowi co jakiś czas o kluczowych zasadach, istnieje spora szansa, że w pewnym momencie po prostu o nich „zapomni”.

Strategie pracy w ograniczonym oknie kontekstowym

Streszczanie i kondensacja informacji

Jedną z najważniejszych technik jest regularne streszczanie. Zamiast trzymać w kontekście całą transkrypcję spotkania, możemy poprosić model, by zrobił z niej zwięzłe podsumowanie z najważniejszymi decyzjami, wymaganiami czy wnioskami. Następnie to podsumowanie staje się nowym, krótszym fragmentem kontekstu.

Ten proces można powtarzać. Z kilku długich rozmów powstaje streszczenie średniego poziomu, a z kilku streszczeń bardziej ogólny opis projektu. Dzięki temu w oknie kontekstowym utrzymujemy informację wysokiej wartości, a nie surowe logi z przeszłości.

Kluczowe jest to, by streszczenie było celowe. Nie wystarczy ogólne „podsumuj rozmowę”; lepiej poprosić o spis decyzji, listę ustalonych wymagań, tabelę z kluczowymi parametrami. Im bardziej strukturalna forma, tym łatwiej używać jej w dalszych krokach.

Strukturyzowanie promptów i rozmowy

Drugą strategią jest świadome budowanie promptów, czyli wejścia dla modelu. Zamiast wrzucać wszystko w jednej masie tekstu, warto wydzielać sekcje. Na przykład

• część „Zasady współpracy”

• część „Dane wejściowe”

• część „Konkretny problem do rozwiązania”

• część „Oczekiwany format odpowiedzi”

Takie uporządkowanie ułatwia modelowi ustalenie, co jest stałym kontekstem, a co jest elementem, który zmienia się w każdej iteracji. Gdy okno kontekstowe jest napięte, łatwiej zredukować na przykład jedną sekcję, zamiast bezwiednie skracać całość.

Podobna zasada dotyczy rozmów. Zamiast luźno przeskakiwać po wątkach, lepiej zamykać jeden temat: podsumować go, wyciągnąć wnioski, zapisać w postaci krótkiej notki, a dopiero potem przejść do kolejnego. W ten sposób minimalizuje się bałagan w kontekście.

Podział zadań na kroki

Modele często lepiej radzą sobie, gdy rozbijamy problem na kilka kroków, zamiast próbować wszystko załatwić w jednym ogromnym wejściu. Na przykład zamiast zasypywać model całym regulaminem, bazą maili, specyfikacją techniczną i prosić od razu o kompleksową analizę, można zastosować podejście wieloetapowe.

Najpierw prosimy o identyfikację kluczowych punktów regulaminu, potem o porównanie ich z wymaganiami klienta, następnie o generację konkretnych sugestii zmian. W każdym kroku kontekst jest mniejszy, bardziej celowy i łatwiejszy do przetworzenia. Jednocześnie końcowe odpowiedzi mogą być bogatsze, bo korzystają z efektu kumulacji pośrednich wniosków.

Długie konteksty i ich wyzwania

Modele z bardzo dużym oknem kontekstowym

W ostatnich latach pojawiły się modele deklarujące obsługę naprawdę długich kontekstów. Można im podać na wejściu setki stron tekstu i wciąż otrzymać sensowną odpowiedź. Brzmi to jak rozwiązanie wszystkich problemów, ale w praktyce jest nieco bardziej skomplikowane.

Długie okno kontekstowe jest bardzo przydatne w niektórych scenariuszach: analiza obszernego dokumentu, praca z kodem systemu składającego się z wielu plików, porównywanie umów, raportów, długich treści. Umożliwia to zadanie typu „przeskanuj wszystko i znajdź odstępstwa od wzorca”.

Jednak samo zwiększenie długości kontekstu nie gwarantuje automatycznie lepszych odpowiedzi. Trzeba jeszcze zadbać o to, by model koncentrował się na tym, co ważne.

Efekt rozmycia uwagi w długim kontekście

Im więcej tekstu w oknie kontekstowym, tym większe ryzyko, że model rozmyje uwagę. Mechanizm self attention co prawda teoretycznie widzi wszystko, ale w praktyce musi rozłożyć swoje zasoby na całą sekwencję. Przy bardzo długich wejściach różne fragmenty rywalizują o jego uwagę.

Efekt ten bywa widoczny w odpowiedziach: model odnosi się do nie do końca właściwego fragmentu dokumentu, myli dwa podobne pojęcia z różnych części, albo udziela odpowiedzi poprawnej w ogólności, ale słabo zakotwiczonej w konkretnym fragmencie, który nas interesuje.

Aby temu przeciwdziałać, warto wprowadzać dodatkowe warstwy struktury: na przykład najpierw poprosić model, by wskazał fragmenty, które są najbardziej związane z naszym pytaniem, a dopiero potem o szczegółową analizę tych fragmentów. Takie podejście przypomina pracę człowieka, który najpierw skanuje dokument wzrokiem i zaznacza ważne paragrafy, zanim wejdzie w detale.

Okno kontekstowe a pamięć zewnętrzna

Retrieval augmented generation, czyli RAG

Jedną z najważniejszych koncepcji, które powstały właśnie w odpowiedzi na ograniczenia okna kontekstowego, jest retrieval augmented generation, w skrócie RAG. Polega ona na tym, że model nie trzyma całej wiedzy potrzebnej do odpowiedzi w samym kontekście, ale ma możliwość odpytywania zewnętrznej bazy wiedzy.

W typowym rozwiązaniu teksty (dokumenty, artykuły, opisy) są indeksowane w taki sposób, by szybko znaleźć fragmenty najbardziej podobne semantycznie do zadania użytkownika. Gdy ktoś zadaje pytanie, system w tle wykonuje wyszukiwanie, pobiera kilka najbardziej pasujących fragmentów i włącza je do okna kontekstowego jako materiał pomocniczy dla modelu.

Dzięki temu nie trzeba ładować całej bazy dokumentów; w oknie kontekstowym znajdują się tylko te kawałki, które są w danej chwili potrzebne. Okno pełni rolę pola roboczego, a nie archiwum.

Zewnętrzne bazy wiedzy i narzędzia

Pamięć zewnętrzna nie musi być wyłącznie tekstowa. System może korzystać z różnych narzędzi: API systemów biznesowych, baz danych, wyszukiwarek, silników obliczeniowych. Kluczowe jest to, by wynik działania tych narzędzi umieścić w oknie kontekstowym jako dane, na podstawie których model może wygenerować odpowiedź.

Z perspektywy użytkownika wygląda to jak „model wszystko wie”; w praktyce ma po prostu dobre łącze z bazą i umie napisać zrozumiały tekst na podstawie zwróconych liczb, rekordów czy dokumentów.

Okno kontekstowe jest tutaj interfejsem między światem narzędzi a modelem językowym. To w nim mieszają się instrukcje, wyniki zapytań i pytania użytkownika. Gdy ten interfejs zapchamy zbędnymi treściami, nawet najlepszy system RAG zacznie się dławić.

Przykłady zastosowań w praktyce biznesowej

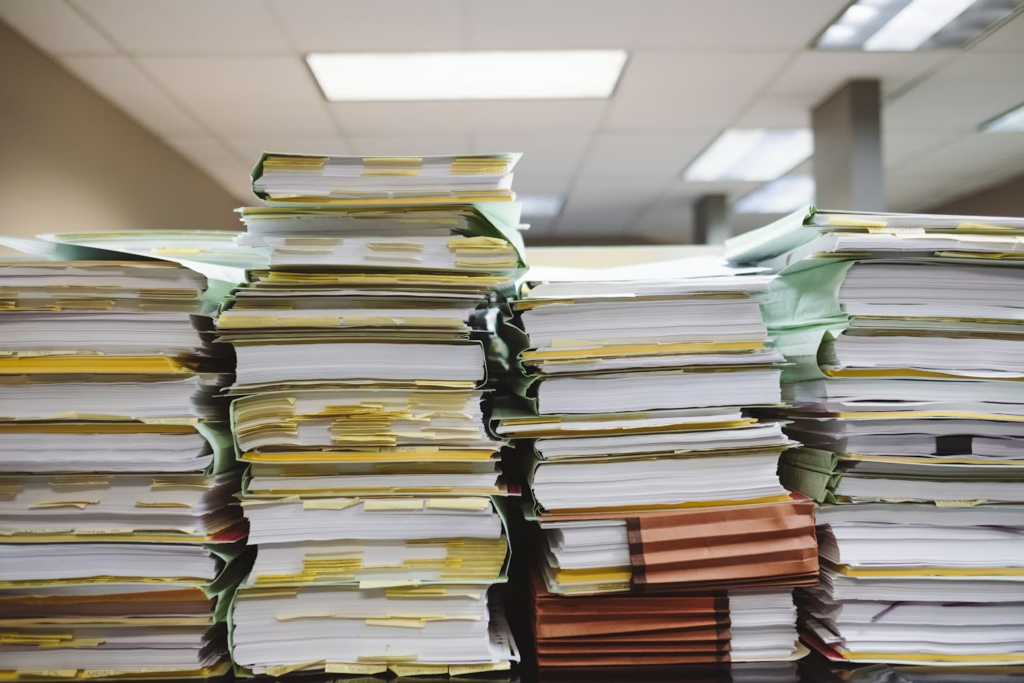

Analiza dokumentów i umów

Wyobraźmy sobie zespół prawny, który pracuje nad standardową umową i jej dziesięcioma różnymi wersjami negocjowanymi z klientami. Można oczywiście wrzucić wszystkie dokumenty do modelu i poprosić o podsumowanie różnic, ale szybko okaże się, że przy większej liczbie wersji okno kontekstowe się zapełni.

Rozsądniejsze podejście to praca etapami. Najpierw dla każdej umowy tworzymy strukturalne streszczenie kluczowych punktów. Następnie porównujemy streszczenia, a nie surowe dokumenty. Dzięki temu w kontekście trzymamy informacje zagęszczone, które dają lepszy obraz różnic, a nie pełne teksty liczące setki stron.

Podobnie można pracować z regulaminami, procedurami czy dokumentacją techniczną. Okno kontekstowe nie musi być śmietnikiem; może pełnić rolę pulpitu analityka, na którym leżą tylko najważniejsze kartki.

Asystenci w aplikacjach i systemach biznesowych

Coraz częściej w systemach biznesowych pojawiają się asystenci AI; w CRM, narzędziach do obsługi klienta, w systemach ERP czy w oprogramowaniu do zarządzania projektami. Taki asystent ma zwykle dostęp do sporej ilości danych: historii kontaktu z klientem, zamówień, zgłoszeń serwisowych, notatek sprzed kilku miesięcy.

Jeśli wszystko to bezpośrednio wrzucimy do okna kontekstowego przy każdej rozmowie, szybko okaże się, że limit jest przekroczony, a koszty rosną. Lepszym podejściem jest selekcja:

• wybieramy kilka ostatnich interakcji z klientem

• dorzucamy streszczenie wcześniejszej historii

• dokładamy aktualne dane z systemu (status zamówienia, otwarte zgłoszenia)

• w razie potrzeby asystent może poprosić o dodatkowe szczegóły z bazy

Tak skonstruowany kontekst jest bogaty, ale kontrolowany; model ma wystarczająco dużo informacji, by zachować ciągłość relacji, a jednocześnie nie pracuje na surowych logach całej wieloletniej współpracy.

Jak myśleć o oknie kontekstowym projektując rozwiązania

Kluczowe pytania przed startem

Zanim zaczniemy budować system oparty na AI, warto zadać sobie kilka pytań o kontekst.

Jakie informacje są absolutnie niezbędne do udzielenia sensownej odpowiedzi

Jakie dane zmieniają się dynamicznie, a jakie są względnie stałe

Co użytkownik wnosi od siebie, a co można wstrzyknąć automatycznie z systemów

Jak długo ma trwać jedna „sesja” z asystentem i czy musi ona być bezwzględnie ciągła

Odpowiedzi na te pytania pomogą ustalić, co powinno być w każdej chwili w oknie kontekstowym, a co można trzymać w pamięci zewnętrznej i dociągać na żądanie. Projektowanie kontekstu staje się wtedy świadomą decyzją architektoniczną, a nie skutkiem ubocznym.

Typowe błędy przy pracy z kontekstem

Do najczęstszych błędów należą:

Mieszanie wielu ról w jednym kontekście. Na przykład gdy model ma naraz być prawnikiem, copywriterem i konsultantem technicznym, a wszystkie instrukcje wrzucamy obok siebie. Dużo lepiej działa rozdzielenie tych ról na osobne „tryby” pracy.

Brak odświeżania zasad. Zakładamy, że skoro na początku konwersacji model dostał długą listę reguł, będzie ich się trzymał przez wiele godzin. W rzeczywistości przy dłuższych rozmowach trzeba co jakiś czas te zasady przypominać w kontekście.

Ładowanie pełnych dokumentów zamiast streszczeń. Kuszące jest wrzucenie całego pliku, ale często wystarczy wybrać fragmenty lub przygotować skrót. Oszczędza to miejsce i zmniejsza ryzyko, że model skupi się na mało istotnych szczegółach.

Stosowanie jednego okna do wszystkiego. Niekiedy lepiej mieć kilka równoległych sesji wyspecjalizowanych: jedna do generowania treści, druga do analizy wymagań, trzecia do pracy z kodem. Każda ma własny, dopasowany kontekst.

Przyszłość okien kontekstowych

Rozwój modeli idzie w kierunku coraz większych okien kontekstowych, ale także coraz sprytniejszego zarządzania uwagą. Pojawiają się techniki, które pozwalają modelowi „skakać” po długim tekście, zamiast pamiętać go cały w jednakowym stopniu. Inne podejścia łączą modele językowe z wyszukiwarkami, grafami wiedzy i narzędziami specjalizowanymi.

Jednocześnie rośnie znaczenie warstwy orkiestracji wokół modelu. Sam model staje się jedynie rdzeniem, a kluczowe decyzje dotyczą tego, co do niego w danym momencie wkładamy. Okno kontekstowe nie jest już tylko technicznym parametrem, lecz elementem projektu biznesowego i użyteczności.

Można się spodziewać, że w kolejnych latach:

• wzrośnie typowy rozmiar okna, co ułatwi pracę z dużymi dokumentami

• powstaną lepsze narzędzia do automatycznego streszczania i selekcji treści

• zarządzanie kontekstem stanie się standardową kompetencją zespołów produktowych i projektantów systemów

Podsumowanie

Okno kontekstowe to miejsce, w którym spotykają się trzy światy: użytkownika, danych i modelu. Z jednej strony jest twardym technicznym limitem; z drugiej od tego, jak je wypełnimy, zależy „osobowość” i skuteczność całego systemu AI.

Rozumiejąc, czym jest kontekst, jak model z niego korzysta i jakie ma ograniczenia, łatwiej projektować sensowne rozwiązania. Zamiast liczyć na to, że model „jakoś sobie poradzi”, lepiej traktować okno kontekstowe jak cenny zasób, o który trzeba dbać: selekcjonować informacje, streszczać je, porządkować, pamiętać o zasadach i unikać śmieci.

Wtedy sztuczna inteligencja przestaje być kapryśną „czarną skrzynką”, a zaczyna być przewidywalnym narzędziem, które robi dokładnie to, na co pozwalamy mu w tym ograniczonym, ale dobrze zaprojektowanym kawałku świata, który nazywamy oknem kontekstowym.