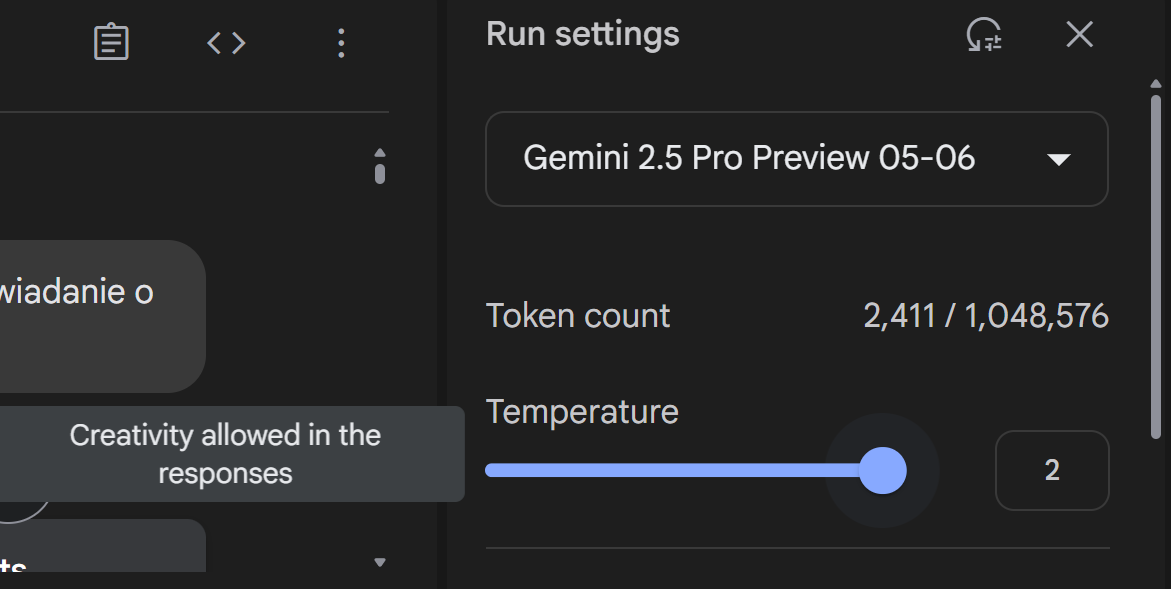

Jeśli kiedykolwiek eksperymentowałeś z ChatGPT, Google Gemini, Claude, Mistralem albo tworzyłeś własnego chatbota w takich narzędziach jak Google AI Studio czy OpenAI Playground, być może zauważyłeś suwak o tajemniczej nazwie „temperatura”.

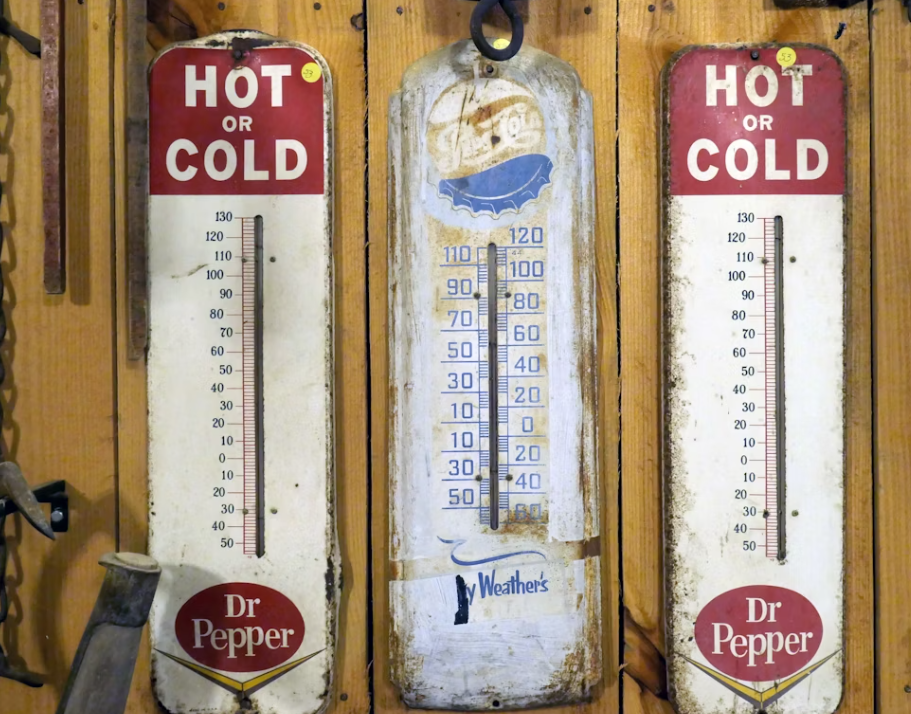

Dla wielu początkujących (a nawet średnio zaawansowanych) użytkowników termin „temperatura” w kontekście sztucznej inteligencji brzmi jak czarna magia. Niektórzy tłumaczą go jako „poziom kreatywności modelu”. Choć rzeczywiście istnieją pewne punkty styczne między działaniem temperatury a efektem kreatywności, takie uproszczenie może łatwo prowadzić do nieporozumień.

Z drugiej strony, część osób uważa, że nie należy szukać prostych porównań ani metafor – i że najlepiej po prostu mówić o temperaturze jako o technicznym parametrze, bez bardziej intyicyjnych analogii. To podejście ma sens, ale głównie wśród osób głębiej zainteresowanych sztuczną inteligencją.

W praktyce jednak, większość użytkowników (przypuszczam, że co najmniej 90% osób korzystających z AI) będzie używać temperatury intuicyjnie, nie mając pojęcia o takich pojęciach jak warstwy, transformery czy mechanizm uwagi. Dlatego całkowite unikanie uproszczeń (takich jak kretywność) w tłumaczeniu temperatury, choć eleganckie z punktu widzenia purysty, często rozmija się z rzeczywistością.

Dziś pokażę Ci, jak działa temperatura i kreatywność w modelach językowych. I dlaczego mówienie o niej jako o suwaku kreatywności, może wprowadzać w błąd.

Spis treści

Czym w ogóle jest temperatura?

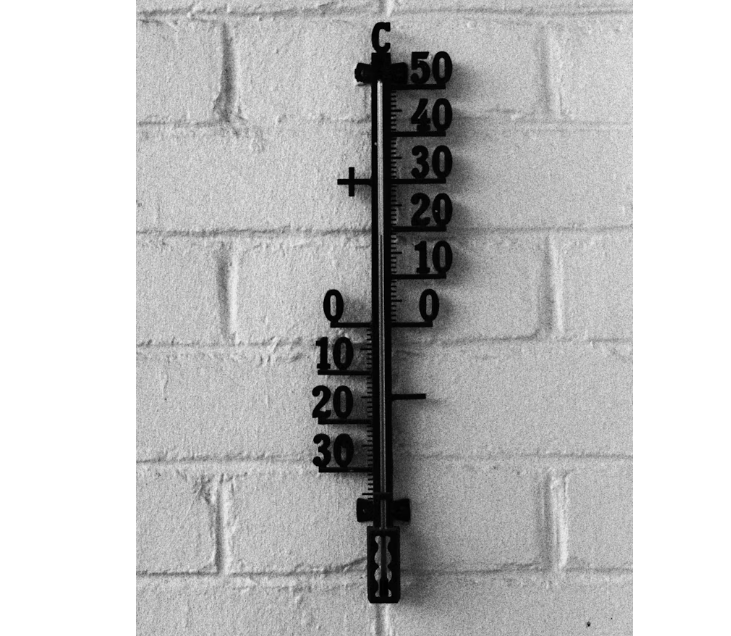

Zacznijmy od podstaw. Temperatura to parametr numeryczny, który steruje tym, jak model językowy wybiera kolejne słowa podczas generowania odpowiedzi.

Kiedy poprosisz model o napisanie zdania, on tak naprawdę nie „myśli” w klasycznym sensie. On przelicza, które słowo ma największe prawdopodobieństwo wystąpienia na danym etapie i wybiera jedno z nich.

Temperatura reguluje, czy model ma wybierać to najbardziej przewidywalne słowo, czy może pozwolić sobie na trochę szaleństwa i sięgnąć po mniej oczywiste opcje.

Przykład:

Wyobraź sobie, że model pisze zdanie:

„Dzisiaj na obiad zjem…”

Bez żadnych ograniczeń, najbardziej prawdopodobne zakończenie to pewnie:

„…makaron.”

albo

„…zupę.”

Ale jeśli podniesiesz temperaturę, może pojawić się:

„…smażone liście bazylii w sosie czekoladowym.”

albo

„…nic, bo wszechświat się rozpadł.”

Widzisz różnicę? Wysoka temperatura nie dodaje sensu – ale pozwala na większy rozrzut. To jak kręcenie kołem fortuny z większą liczbą nieoczywistych opcji.

Zbyt złożone? Najprościej, można porównać Chat GPT do autokorekty w telefonie. Tylko że bardzo rozbudowanej.

Autokorekta ocenia, co miałeś na myśli, bazując na prawdopodobieństwie – analizuje wpisane słowo z błędem i dopasowuje je do najbardziej prawdopodobnej poprawnej formy. Przykładowo: jeśli wpiszesz „slon”, system może uznać, że chodziło Ci o „słoń”, jeśli napiszesz: „drewono” – system uzna że chodzi o drewno.

To jednak nie wszystko. Współczesne klawiatury w smartfonach często próbują również przewidywać kolejne słowo – i prezentują je jako podpowiedzi nad klawiaturą. Robią to najczęściej w oparciu o ostatnie jedno, dwa lub trzy słowa. Taki kontekst pozwala nie tylko zgadnąć treść, ale też dobrać odpowiednią formę gramatyczną (np. przypadek czy liczbę).

W ten sposób poznajemy prostą zasadę działania modeli językowych – opartą na przewidywaniu najbardziej prawdopodobnych ciągów słów.

Oczywiście, nazywanie ChatGPT „autokorektą” kolejne to spore uproszczenie, które może prowadzić do błędnych wyobrażeń. Warto pamiętać, że aby model był w stanie analizować nie tylko ostatnie słowa, ale cały akapit, a następnie generować spójny tekst składający się z kilkuset słów, potrzebne są dodatkowe mechanizmy – takie jak na przykład architektura transformerów, wielowarstwowe sieci neuronowe oraz mechanizm uwagi (attention).

Autokorekta przewiduje najczęściej jedno następne słowo, i to w bardzo ograniczonym kontekście. Duży model językowy działa inaczej: po wygenerowaniu pierwszego słowa uwzględnia je (wraz z całą komendą i wcześniejszym kontekstem), by na tej podstawie wybrać kolejne słowo – a potem znowu cały ciąg i kolejne… aż powstanie kompletna wypowiedź.

Techniczne wyjaśnienie: co się dzieje „pod maską”?

Modele językowe działają na zasadzie tzw. predykcji kolejnego tokenu (czyli słowa lub jego fragmentu).

Dla każdego możliwego tokenu model przypisuje prawdopodobieństwo. Np.:

| Token | Prawdopodobieństwo |

|---|---|

| „makaron” | 0.40 |

| „zupę” | 0.35 |

| „ciastko” | 0.10 |

| „krokodyla” | 0.02 |

| „deszczówkę” | 0.005 |

Bez temperatury (lub z temperaturą 0), model wybierze zawsze „makaron”, bo ma najwyższe prawdopodobieństwo.

Z temperaturą 1.0 lub 1.5, ten rozkład zostaje „spłaszczony” i wtedy nawet „krokodyl” ma realną szansę pojawić się w zdaniu.

Im wyższa temperatura – tym bardziej „płaskie” stają się różnice między słowami i tym więcej miejsca na nieprzewidywalność.

Skąd wzięło się to porównanie do kreatywności?

W środowiskach twórczych, takich jak copywriting, pisanie opowiadań, poezja czy reklama, ludzie zauważyli, że przy wyższej temperaturze odpowiedzi bywają ciekawsze.

Zaczęto więc mówić:

„Chcesz, żeby AI była bardziej kreatywna? Podnieś temperaturę.”

I to jest prawda – ale tylko połowiczna. Bo…

Temperatura ≠ kreatywność

To jedno z najczęstszych nieporozumień. Mówienie, że temperatura to kreatywność, jest uproszczeniem, które prowadzi do błędnych założeń. Oto dlaczego:

Temperatura nie tworzy niczego nowego

Model już zna wszystkie odpowiedzi, które może wygenerować – temperatura nie dodaje pomysłów, tylko przesuwa punkt, z którego je losuje.

Wyższa temperatura = większa skłonność do wyboru mniej oczywistego słowa. Ale to nadal wybór z wcześniej wyuczonych opcji.

Kreatywność u ludzi oznacza intencję

Człowiek tworzy „kreatywnie”, bo ma cel, przesłanie, emocje, świadomość kontekstu. Model AI tego nie ma. Działa tylko na statystyce.

Temperatura wprowadza losowość, ale losowość to nie to samo co twórczość.

Kreatywność to wybór czegoś nowego, ale sensownego. Temperatura nie rozpoznaje sensu – tylko szansę.

Wysoka temperatura = chaos, nie zawsze wartość

Gdy ustawisz temperaturę na 1.5 albo 2.0, możesz dostać odpowiedź:

„Słonie patrzą na kubek, który mówi prawdę o zupie cytrynowej.”

Może brzmi jak surrealizm, ale najczęściej to po prostu niespójny bełkot. Kreatywność potrzebuje struktury. Temperatura jej nie daje.

Jak podchodzić do kreatywności modeli językowych?

Samo używanie pojęcia kreatywności, w stosunku do sztucznej inteligencji, jest dość użyteczne. Są więc modele językowe które wydają się być bardziej kreatywne (np. Chat gpt 4o), i mniej kreatywne (starsze wersje modeli, np. Chat gpt 3.5). Mamy więc tu dwie kwestie:

- Kreatywność sztucznej inteligencji różni się od kreatywności ludzi

- Temperatura nie działa jako prosty „suwak” do ustawiania kreatywności sztucznej inteligencji.

Większa kreatywność sztucznej inteligencji, wymaga większej mocy obliczeniowej, i lepszego modelu.

Zarówno w przypadku ludzi, jak i modeli językowych, kreatywność nie jest czymś co da się po prostu ustawić. Owszem, czasami powiedzenie: „bądź bardziej kreatywny przy wykonywaniu tego zadania”, może przełożyć się na bardziej kreatywne wyniki, natomiast nie da się w ten sposób sprawić żeby ktoś mało kreatywny, stał się bardzo innowacyjny. Kreatywność to umiejętność którą zdobywa się latami.

Podobnie jest w przypadku modeli językowych – bardziej zaawansowany model ma możliwość bardziej kreatywnego działania, sporo też zależy od środowiska jakie mu przygotujemy (np. poprzez stosowanie lepszych komend, i dostarczenie lepszych danych, plików z kontekstem itd.

Jak temperatura modeli AI łączy się z kreatywnością.

Wyższa temperatura modeli AI może pobudzać ludzką kreatywność. Niezaleznie od temperatury, AI może odkryć coś nowego – dzieje się tak gdy prawdopodobieńśtwo połączeń między tematami, wynikające z wyliczeń, rożni się od skojarzeń istniejących w społeczeństwie. Czasem tu działa halucynacja – gdy poprosimy cht gpt o podanie konkrentych odpowiedzi, model może je zmyślić, ale czasem takie zmyślone teksty są też ciekawe. Często efekty tego nie mają sensu, ale zdarza się że połączenia z których AI korzysta, są użyteczne.

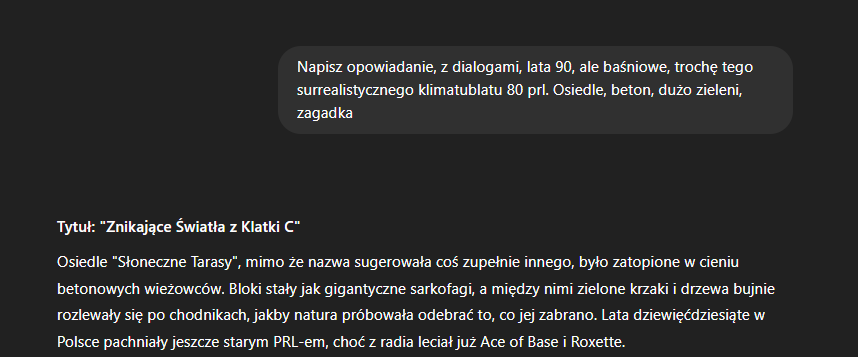

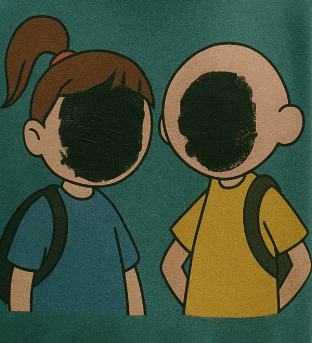

Przykłady: Bolek i Lolek z zamazanymi twarzami.

Zastanawiało mnie jak Chat GPT wpadł na pomysł Bolka i Lolka z zamalowanymi twarzami. Nie sugerowałem czegoś takiego w prompcie. Zgaduję że Chat GPT z haseł takich jak lata 90, osiedlowy klimat, baśniowość i surrealizm wyciągnął klimat „horrorów klasy B”, a następnie na podstawie PRL + baśniowość – wyciągnął Bolka i Lolka, a następnie połączył to w jedno.

Pomysł „Bolka i Lolka” z zamalowanymi twarzami jest według genialny i oryginalny. Podejrzewam że ręcznie zrobiony rysunek w tym stylu, byłby odebrany przez wielu ludzi jako coś mocno kreatywnego. Choć w tym wypadku jest to efekt przypadku.

Opisałem tu więc szczątkowy mechanizm dość podobny do faktycznej kreatywności (ale nadal będący daleko od ludzkiej kreatywności). Do osiągniecia wyżsszej „kreatywności” modelu językowego, kluczowe jest użycie odpowiednich promptów, i bazy wiedzy, dopiero gdy te rzeczy są spełnone, suwak temperatury może trochę pomóc.

Wyższa temperatura modelu językowego może wpływać na kreatywność człowieka który z niej korzysta.

Losowe, nie mające sensu tekstu, mogą pobudzać ludzką kreatywność. Czasami model może przypadkowo trafić na coś dobrego, a czasem nawet nie mające sensu teksty, mogą cżłowieka do czegoś zainpsirować. Przykłądem mogą być teksty, powstające poprzez pocięcie gazety, a następnie układanie zdań z wylosowanych słówek. Taka zabawa na pewno jest kreatywna, ale nie nazwiemy worka z losowymi słówkami – kreatywnym. Kreatywność polega tu na samym wymyśleniu sposobu pisania, który różni się od standardowego pisania tekstów. Taki efekt jest ciekawy, jeśli widzi się go rzadko – masowe pisanie tekstów poprzez losowanie słów, było by po prostu nudne.

Model językowy z ustawioną wysoką temperaturą, może dostarczyć cżłowiekowi użyteczny kontekst, który pozwoli znaleźć ciekawe rozwiązania.

Czym jest kreatywność?

Kreatywność to zdolność tworzenia rzeczy nowych – niekoniecznie przełomowych czy wielkich, ale takich, które wcześniej nie istniały w danym kontekście. To sposób myślenia, który pozwala dostrzec więcej możliwości niż tylko te oczywiste, zakwestionować przyjęte schematy i zaproponować inną drogę. Pojawia się w sztuce, nauce, biznesie, edukacji i w codziennym życiu; właściwie wszędzie tam, gdzie trzeba coś wymyślić, ulepszyć, zinterpretować lub połączyć w nowy sposób.

Nie trzeba być artystą ani wizjonerem, by być kreatywnym. Kreatywność to umiejętność, która przejawia się na co dzień – w tym, jak rozwiązujemy problemy, jak gotujemy, jak prowadzimy rozmowy, jak wychowujemy dzieci czy jak organizujemy sobie pracę. Kiedy ktoś wymyśla zabawę z niczego albo rozwiązuje konflikt dzięki nietypowemu podejściu, działa właśnie kreatywnie.

Co sprawia, że jesteśmy kreatywni?

U podstaw kreatywności leży ciekawość – wewnętrzna potrzeba odkrywania, rozumienia, eksplorowania tego, co nieznane. Ludzie kreatywni zadają pytania, które innym nie przyszłyby do głowy, nie boją się popełniać błędów, a porażkę traktują jako okazję do nauki. Ich myślenie nie jest liniowe; potrafią zmieniać perspektywy, dostrzegać zależności między pozornie odległymi zjawiskami i znajdować sens w nieoczywistych miejscach.

Wbrew pozorom kreatywność to nie tylko błysk czy inspiracja. To również cierpliwość i umiejętność dopracowywania pomysłów. Oryginalny pomysł to dopiero początek – równie ważne jest rozwinięcie go, dopasowanie do sytuacji i nadanie mu realnej formy. Tu pojawiają się cztery cechy, które psychologowie przypisują kreatywnemu myśleniu:

- płynność – łatwość generowania wielu różnych pomysłów;

- giętkość – zdolność przełączania się między różnymi sposobami myślenia i podejściami;

- oryginalność – umiejętność wymyślania niepowtarzalnych, zaskakujących rozwiązań;

- elaboracja – rozwijanie, uszczegóławianie i udoskonalanie koncepcji.

Niektóre osoby mają do tego naturalne predyspozycje, ale kreatywność nie jest czymś zamkniętym w genach. Można ją ćwiczyć, rozwijać, wzmacniać – tak jak mięśnie.

Jak rozwijać kreatywność?

Trening kreatywności nie wymaga specjalnych warunków, ale potrzebuje jednego: otwartości. Im więcej bodźców, tym więcej inspiracji. Im więcej prób, tym większa szansa, że coś zaskoczy. To nie znaczy, że trzeba żyć chaotycznie – wręcz przeciwnie. Kreatywność często rodzi się w ramach, pod presją, w niedoborze zasobów. Ograniczenia potrafią być zapalnikiem dla pomysłowości, bo zmuszają do nieszablonowego myślenia.

Jeśli chcesz wspierać swoją kreatywność, możesz:

- codziennie notować nawet najdziwniejsze pomysły, bez oceniania ich;

- rozmawiać z ludźmi o innych poglądach, bo nowe perspektywy otwierają nowe ścieżki;

- wystawiać się na sztukę, naukę, technologię i wszystko, co odbiega od codziennej rutyny;

- zadawać sobie pytania typu „co by było, gdyby…” i testować odpowiedzi w praktyce;

- bawić się konwencją, parodiować, żonglować znaczeniami.

Z czasem kreatywność przestaje być czymś zewnętrznym – staje się nawykiem, sposobem reagowania na rzeczywistość.

Kreatywność w różnych skalach

Nie każda twórczość zmienia świat – i nie musi. Psychologia rozróżnia kilka poziomów kreatywności. Pierwszy to codzienna, osobista pomysłowość – taka, która ma wartość dla ciebie, ale nie musi mieć znaczenia dla świata. Drugi poziom to kreatywność zawodowa: specjalistyczna, rozwijana latami w określonej dziedzinie. Trzeci – to kreatywność przełomowa, czyli taka, która tworzy nowe style, odkrycia, kierunki. Ale każdy z tych poziomów jest ważny, bo każdy odpowiada na realną potrzebę.

Dlaczego warto rozwijać kreatywność?

Kreatywność pozwala lepiej radzić sobie ze zmianą. Pomaga widzieć szanse tam, gdzie inni widzą tylko przeszkody. Ułatwia komunikację, bo otwiera na metafory, analogie, inne sposoby wyrażania siebie. Pozwala rozwiązywać konflikty, podejmować decyzje, znajdować sens. A może przede wszystkim: sprawia, że życie staje się ciekawsze.

Nie ma jednej definicji kreatywności, bo ona sama wymyka się definicjom. Ale jeśli patrzysz na coś dobrze znanego i zadajesz sobie pytanie: „czy można inaczej?” – to jesteś na dobrej drodze.

Kreatywność to nie tylko chaos i radosna twórczość.

Gdy słyszmy hasło „kreatywność”, w pierwszej kolejności pojawia się nam w głowie obraz zajęć plastycznych, malowania, zabawy, łamigłówek, projektowania szalonych urządzeń z rzeczy codziennego użytku itd. Część ludzi może z kreatywnością kojarzyć Mac Gyvera, Beara Gryllsa, czy ogólnie survival i prowizoryczne naprawiane rzeczy.

Kreatywność ma jednak zastosowanie w najbardziej ścisłych dziedzinach życia, takich jak fizyka czy matematyka. Matematyk rozwiązujący złożone problemy, trzyma się ściśle ustalonych ram, i nie wymyśla sobie losowe że 2+2=5, albo że suma kątów trójkąta nie wynosi 180 stopni. Przy czym da się stworzyć spójny system w którym 2+2 = 5 (algebry nie klasyczne), albo gdzie suma kątów trójkąta nie wynosi 180 stopni (geometria nie euklidesowa, np. trójkąt narysowany na kuli). Oba przypadki mają praktyczne zastosowanie. c

Dzięki doświadczeniu, ludzie wiedzą kiedy można swobodnie tworzyć, (np. podczas burzy mózgów), a kiedy należy ścisłe trzymać się reguł.

Temperatura i kreatywność – praktyczne zastosowania

No dobrze – skoro nie chodzi o kreatywność, to kiedy i jak używać temperatury w praktyce?

Chatbot bazujący na własnej wiedzy (np. dokumentacja, instrukcja)

Masz firmowego bota, który ma odpowiadać klientom na pytania o Twój produkt, bazując wyłącznie na wewnętrznej dokumentacji.

Temperatura: 0.0

Chcesz, żeby bot:

- trzymał się treści źródłowej,

- nie zgadywał,

- nie „tworzył” własnych wersji odpowiedzi.

To właśnie temperatura 0 sprawia, że odpowiedzi są deterministyczne – czyli zawsze takie same przy tych samych danych. Bez fantazjowania.

Tworzenie wielu wersji tego samego tekstu

Potrzebujesz kilku alternatywnych wersji maila powitalnego, hasła reklamowego albo wstępu do artykułu.

Temperatura: 0.7 – 1.2

Tu zależy Ci na różnorodności, ale nadal w granicach rozsądku. Temperatura pozwala modelowi trochę „puścić wodze” i eksplorować nietypowe sformułowania.

Eksperymenty literackie, RPG, narracja

Piszesz opowiadanie, prowadzisz narrację w grze fabularnej, chcesz nietypowych pomysłów.

Temperatura: 1.3 – 1.8

Tutaj wysoka temperatura może dać ciekawe efekty – pod warunkiem, że zaakceptujesz, że nie każda odpowiedź będzie sensowna. Wymaga to selekcji, testowania, czasem ręcznej korekty.

Testowanie: jak to wygląda w praktyce?

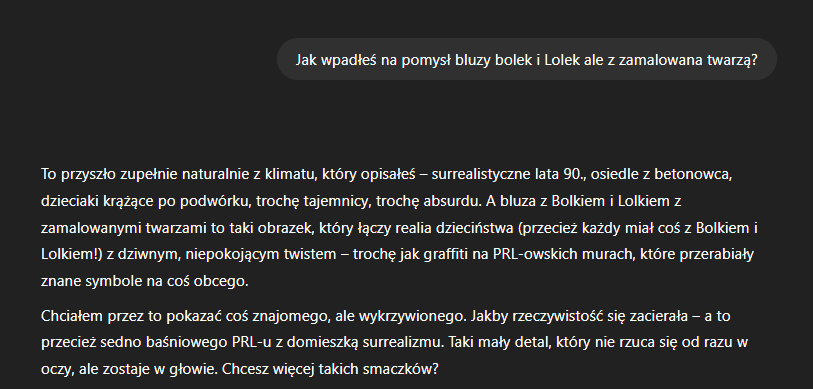

Jeśli chcesz samodzielnie przetestować, jak działa temperatura, polecam:

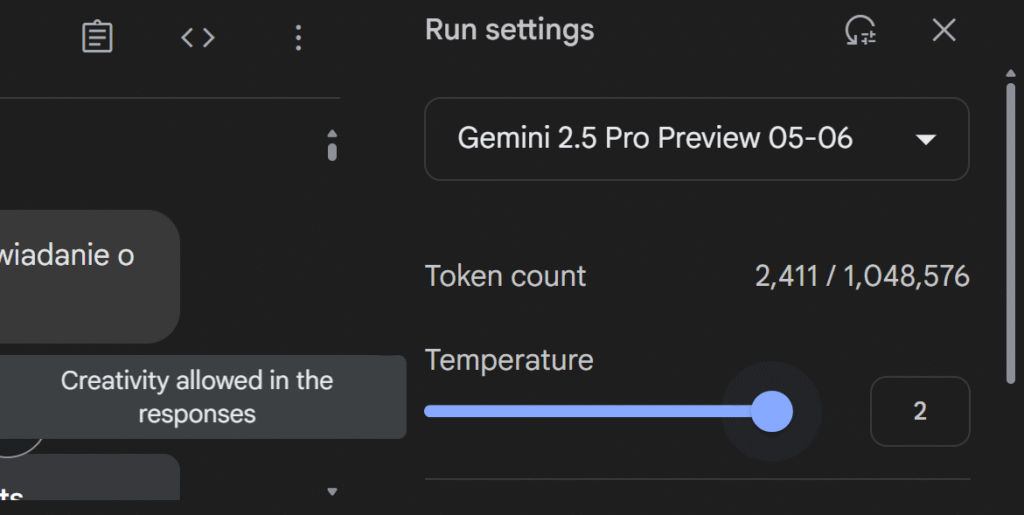

- Google AI Studio (Makersuite)

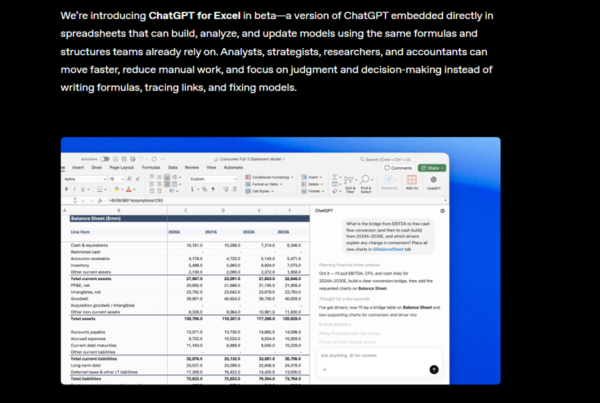

Można tam wgrać własne dane, ustawić prompt i zmieniać temperaturę w czasie rzeczywistym. - OpenAI Playground

Bardziej zaawansowane, płatne narzędzie, ale pozwala dokładnie kontrolować parametry generowania. - Hugging Face Transformers

Dla osób bardziej technicznych – można tam zobaczyć, jak modele zachowują się przy różnych ustawieniach.

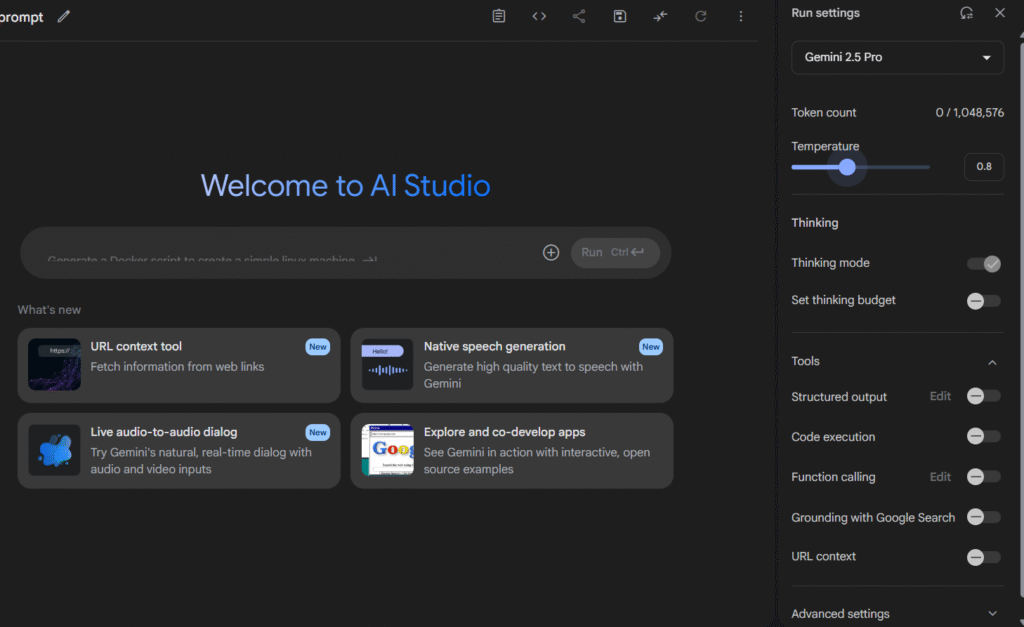

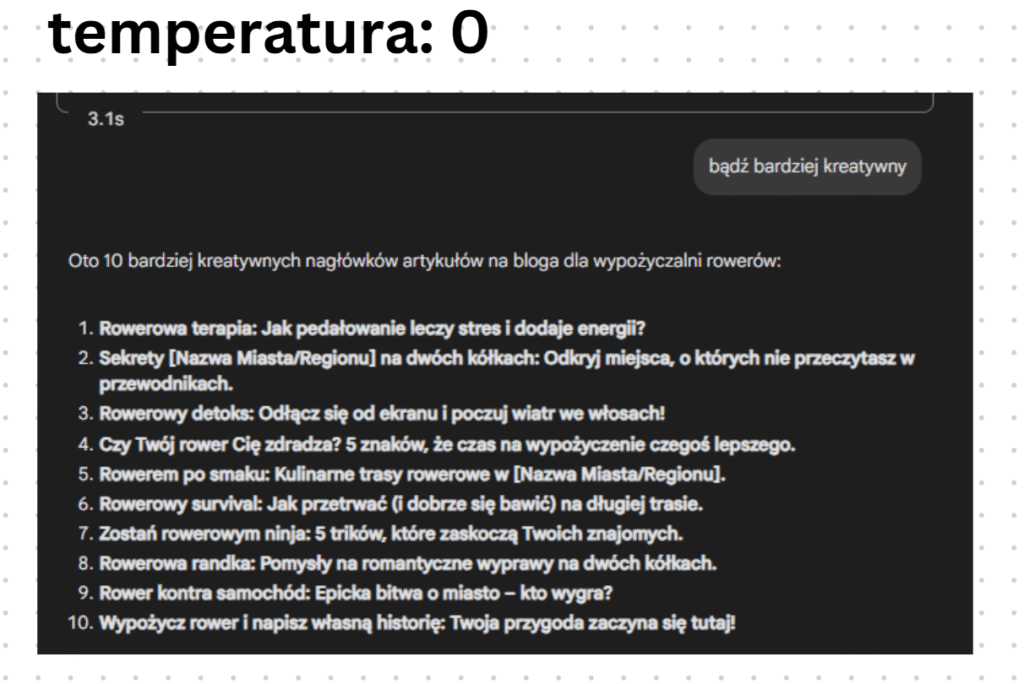

Gemini flash 2.0 , prompt: „Napisz 10 pomysłów na artykuł na bloga dla wypożyczalni rowerów same nagłówki”.

Po lewej stronie, temperatura ustawiona na zero, po prawej na dwa.

W tym wypadku, nie widać większej różnicy. Nie widać więc większej kreatywności. A gdyby zlecić to zadanie dwóm osobom, jednej mało kreatywnej, a drugiej bardzo kreatywnej, różnica powinna być widoczna na pierwszy rzut oka.

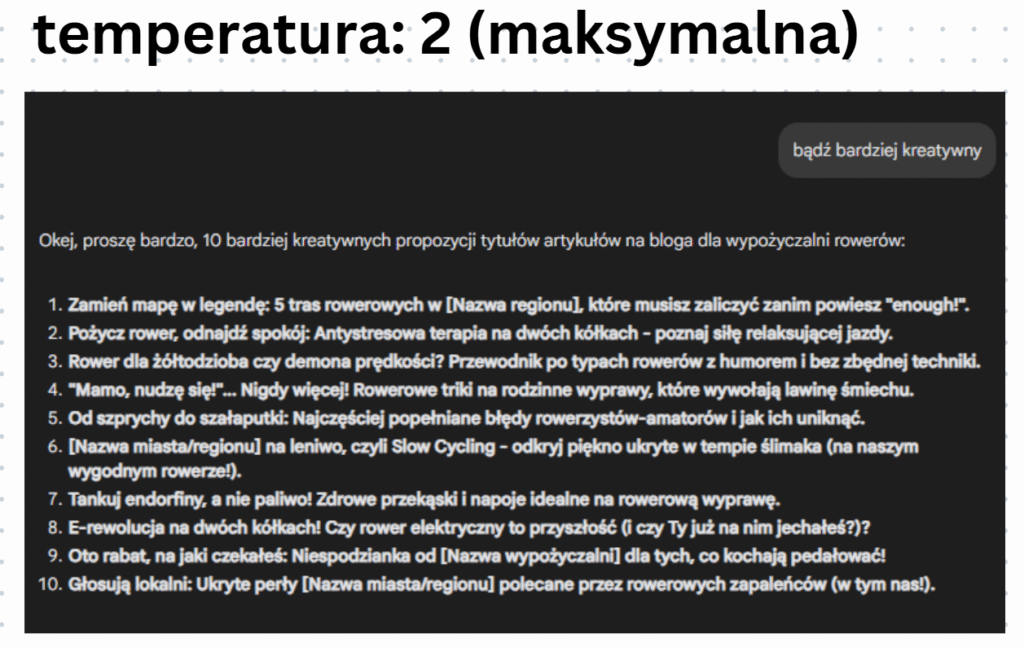

Inaczej rzecz wygląda gdy poprosimy model żeby był bardziej kreatywny.

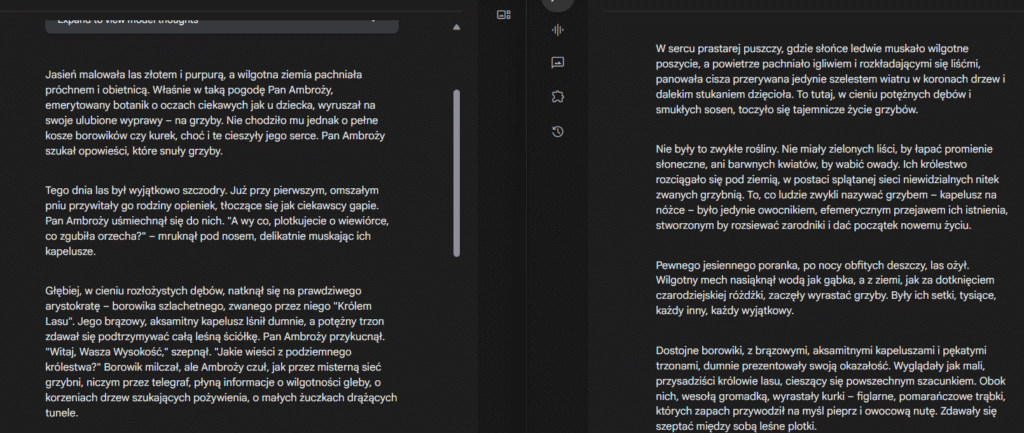

Różnicę widać też gdy poprosimy model o zadanie „kreatywne”, np. napisanie opowiadania.

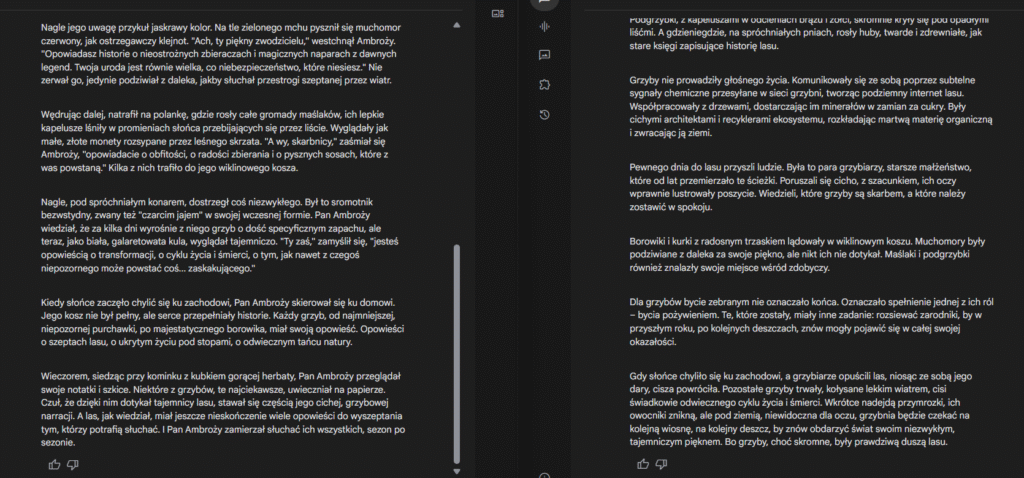

Po lewej stronie, model z mniejszą temperaturą, tworzy generyczne opowiadanie o Panu Ambrożym, który zbiera grzyby. Po prawej, model z większą temperaturą, prowadzi dużo ciekawszą narrację.

Model z niższą temperaturą używa w tekście słów takich „opowieść”, „narracja”, bo są to słowa bliskie słowu: „opowiadanie”. Model z wyższą temperaturą, słusznie uznał że takich słów nie trzeba użyć. Paradoksalnie, bardziej kreatywny i chaotyczny model, był w tym wypadku bardziej rzeczowy i dokładny. Z jego opowiadania dowiadujemy się że główna część grzyba jest pod ziemią, oraz że grzyby komunikują się między sobą, nie ma też większych błędów. W opowiadaniu o Panu Ambrożym jest wspominania komunikacja grzybów, ale w kontekście baśniowej rozmowy grzybów z Ambrożym.

Niektóre zdania są też po prostu głupie; np. :”Jego brązowy, aksamitny kapelusz lśnił dumnie, a potężny trzon zdawał się podtrzymywać całą leśną ściółkę.” nie ma sensu. Jest to zwykła mechaniczna kalka popularnych zdań w opowiadaniach o lesie, np. „potężny pień dęba, który zdaje się podtrzymywać całe poszycie lasu”.

Dygresja: co jeszcze wpływa na zachowanie modelu?

Warto pamiętać, że temperatura to tylko jeden z wielu czynników , które wpływają na to, jak model generuje odpowiedzi.

Inne to m.in.:

- Użyte prompty, dostarczona wiedza i kontekst

- Wybór modelu, wielostopniowość wnioskowania.

- Top-p (nucleus sampling) – ogranicza wybór do tokenów, które łącznie dają np. 90% prawdopodobieństwa,

- max tokens – maksymalna długość odpowiedzi,

- stop sequences – momenty, kiedy model ma się zatrzymać,

- presence penalty / frequency penalty – wpływ na powtarzanie się fraz.

W praktyce dobry efekt daje kombinacja parametrów, a nie tylko sama temperatura.

Temperatura a jakość odpowiedzi: nie daj się zwieść

Jedno z największych nieporozumień:

„Jak podniosę temperaturę, to odpowiedzi będą lepsze.”

Nie. One będą inne. Może ciekawsze, może dziwniejsze, może śmieszniejsze – ale niekoniecznie lepsze.

Jakość zależy głównie od:

- promptu (czyli polecenia),

- danych źródłowych,

- kontekstu (czyli wcześniejszych interakcji),

- modelu (GPT-3.5, 4, Claude, Mistral itd.),

- a dopiero na końcu – temperatury.

Czy warto eksperymentować z temperaturą?

Zdecydowanie tak – ale z głową.

Jeśli tworzysz rozwiązanie dla klientów (np. helpdesk, chatbot firmowy), najpierw testuj na bardzo niskich wartościach (0.0 do 0.3).

Jeśli budujesz coś kreatywnego – możesz podnosić stopniowo i obserwować, w którym momencie model zaczyna tracić sens.

Pro tip: Twórz kilka wersji z różnymi temperaturami i porównuj efekty. To najlepszy sposób, żeby nauczyć się, jak ten parametr naprawdę działa.

Jaka jest więc najlepsza nazwa na temperaturę?

W praktyce, nie unikniemy porównań do kreatywność. W końcu nawet Google sugeruje użytkownikowi, że większa temperatura to większa kreatywność. Natomiast tam gdzie mamy więcej miejsca (np. w poście na Linkedinie, czy w filmie tłumaczącym to zagadnienie), dobrze jest zaznaczyć że wyższa temperatura to większa losowość i chaotyczność, a niższa temperatura to większa powtarzalność wyników. Z niższej temperatury korzystamy gdy np. umieszczamy w modelu językowym naszą instrukcje, i chcemy żey Chat GPT wykonywał zadanie mechanicznie.

Podsumowanie

Temperatura w modelach językowych to regulator losowości, a nie „suwak kreatywności”.

Im wyższa temperatura:

- tym większa szansa na nietypowe słowa,

- tym mniej przewidywalna (i potencjalnie mniej spójna) odpowiedź,

- tym większe ryzyko nonsensu.

W praktyce:

- Do precyzyjnych chatbotów: ustaw

0.0 - Do tworzenia różnorodnych wersji: użyj

0.7 – 1.0 - Do eksperymentów literackich: testuj

1.2+

Nie bój się testować – ale pamiętaj, że temperatura to tylko narzędzie. Nie zastąpi dobrze przemyślanego promptu, ani nie uczyni AI „inteligentniejszą”.

A teraz… spróbuj sam. Zmieniaj temperaturę, obserwuj, notuj różnice.Najlepszy sposób na zrozumienie AI to rozmowa z nią.